Implementierung von Quality of Service

Inhalt

Einführung

Dieses Dokument enthält einige allgemeine Richtlinien für die Implementierung von Quality of Service (QoS) in einem Netzwerk, das als Übertragung für mehrere Anwendungen dient, einschließlich verzögerungsempfindlicher und bandbreitenintensiver Anwendungen. Diese Anwendungen können Geschäftsprozesse optimieren, aber die Netzwerkressourcen beanspruchen. QoS kann für diese Anwendungen sichere, vorhersehbare, messbare und garantierte Services bereitstellen, indem Verzögerungen, Verzögerungsschwankungen (Jitter), Bandbreite und Paketverluste in einem Netzwerk verwaltet werden.

Welche Anwendungen benötigen QoS?

Bestimmen Sie zunächst, welche Anwendungen geschäftskritisch sind und geschützt werden müssen. Möglicherweise müssen Sie alle Anwendungen überprüfen, die um Netzwerkressourcen konkurrieren. Verwenden Sie in diesem Fall NetFlow Accounting, Network-Based Application Recognition (NBAR) oder QoS Device Manager (QDM) zur Analyse der Datenverkehrsmuster im Netzwerk.

NetFlow Accounting bietet detaillierte Informationen zum Netzwerkverkehr und kann zur Erfassung der Klassifizierung oder Rangfolge des Datenverkehrs verwendet werden, der jedem Datenfluss zugeordnet ist.

NBAR ist ein Klassifizierungstool, das den Datenverkehr bis zur Anwendungsebene identifizieren kann. Es stellt Statistiken für jeden Datenverkehrsfluss, der eine Schnittstelle durchläuft, pro Schnittstelle, pro Protokoll und bidirektional bereit. NBAR klassifiziert auch Sub-Ports. Suche und Identifizierung über Anwendungsports hinweg.

QDM ist eine webbasierte Netzwerkverwaltungsanwendung, die eine benutzerfreundliche grafische Benutzeroberfläche für die Konfiguration und Überwachung erweiterter IP-basierter QoS-Funktionen in Routern bereitstellt.

Anwendungseigenschaften

Es ist wichtig, die Merkmale der Anwendungen zu verstehen, die geschützt werden müssen. Manche Anwendungen reagieren tendenziell empfindlich auf Latenz oder Paketverluste, während andere Anwendungen als "aggressiv" gelten, da sie überlastet sind oder eine Menge Bandbreite beanspruchen. Wenn die Anwendung bursty (Burst) ist, stellen Sie fest, ob ein konstanter Burst oder ein kleiner Burst vorliegt. Ist die Paketgröße der Anwendung groß oder klein? Basiert die Anwendung TCP oder UDP?

| Charakteristisch | Leitlinie |

|---|---|

| Eine verzögerungs- oder verlustempfindliche Anwendung. (Sprache und Echtzeit-Video) | WRED (Weighted Random Early Detection), Traffic Shaping, Fragmentation (FRF-12) oder Policing nicht verwenden. Für diese Art von Datenverkehr sollten Sie Low Latency Queuing (LLQ) implementieren und eine Prioritätswarteschlange für verzögerungsempfindlichen Datenverkehr verwenden. |

| Eine Anwendung, die durchgehend bursty oder bandbreitenintensiv ist. (FTP und HTTP) | Verwenden Sie WRED, Richtlinienvergabe, Traffic Shaping oder Class-Based Weighted Fair Queuing (CBWFQ), um die Bandbreite zu gewährleisten. |

| TCP-basierte Anwendung. | Verwenden Sie WRED, da verlorene Pakete dazu führen, dass TCP sich absichert und dann mithilfe des Algorithmus zum Starten von Datenverlusten wieder hochfährt. Wenn der Datenverkehr UDP-basiert ist und sein Verhalten bei Paketverlusten nicht ändert, sollten Sie WRED nicht verwenden. Verwenden Sie Policing, wenn Sie die Anwendung begrenzen müssen. ansonsten einfach die Pakete "Tail-Drop" lassen. |

Kenntnis der Netzwerktopologie

Einige Geräte benötigen möglicherweise ein IOS-Upgrade, um die zu implementierenden QoS-Funktionen nutzen zu können. Mithilfe von Diagrammen für die Netzwerktopologie, die Router-Konfigurationen und die Softwareversion der einzelnen Geräte können Sie die Anzahl der Geräte schätzen, für die ein IOS-Upgrade erforderlich ist. In der Cisco Icon Library finden Sie Symbole, die Ihnen beim Erstellen von Netzwerkdiagrammen helfen können.

-

Analysieren Sie die CPU-Auslastung der einzelnen Router in Spitzenzeiten, um zu entscheiden, wie QoS-Funktionen auf die Geräte verteilt werden, um die Last zu teilen.

-

Klassifizieren Sie geschäftskritische Datenverkehrstypen und die Schnittstellen, die dieser Datenverkehr durchläuft. Legen Sie fest, welche Prioritätsgruppen oder -klassen erstellt werden sollen, um die QoS-Ziele für Ihr Netzwerk zu erreichen.

-

Bestimmen Sie die maximale Verzögerung, mit der die wichtigsten Anwendungen die Burst-Parameter in den Traffic Conditioner (Traffic Shaper oder Policer) verarbeiten und anpassen können, um diese Verzögerung aufzufangen.

-

Erfahren Sie, welche Raten von den einzelnen Schnittstellen unterstützt werden: PVCs oder Subschnittstellen, und die entsprechende Bandbreite konfigurieren.

-

Identifizieren Sie langsame Verbindungen, um festzustellen, wo sich die Engpässe im Netzwerk befinden, und entscheiden Sie, wie die Verbindungseffizienzmechanismen an den entsprechenden Schnittstellen angewendet werden.

-

Berechnen Sie den Layer-2- und Layer-3-Overhead für jeden Medientyp, der den geschäftskritischen Datenverkehr transportiert. Dadurch kann die für jede Klasse benötigte Bandbreite berechnet werden.

-

Eine weitere wichtige Information ist, ob Sie den Datenverkehr auf Basis von Anwendung, IP-Quelle und Ziel oder beidem schützen möchten.

Headergrößen für die Verbindungsschicht

| Medientyp | Link-Layer-Header |

|---|---|

| Ethernet | 14 Byte |

| PPP | 6 Byte |

| Frame-Relay | 4 Byte |

| Geldautomat | 5 Byte/Zelle |

Erstellen von Klassen basierend auf den Kriterien

Sobald Sie ermittelt haben, welche Anwendungen QoS benötigen und welche Klassifizierungskriterien (basierend auf den Eigenschaften der Anwendungen) verwendet werden sollen, können Sie auf der Grundlage dieser Informationen Klassen erstellen.

Erstellen einer Richtlinie zum Markieren jeder Klasse

Erstellen Sie eine Richtlinie, um jede Datenverkehrsklasse mit den entsprechenden Prioritätswerten zu kennzeichnen (mithilfe von Differentiated Services Control Point (DSCP) oder IP Precedence). Der Datenverkehr wird markiert, wenn er in den Router an der Eingangs-Schnittstelle eingeht. Die Markierungen werden verwendet, um den Datenverkehr zu behandeln, während er den Router an der Ausgangsschnittstelle verlässt.

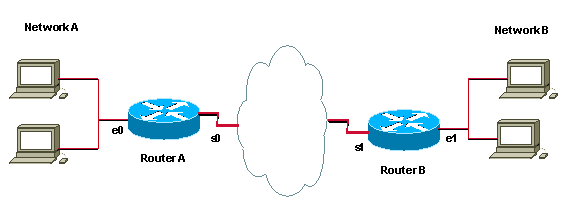

Arbeiten vom Edge zum Core

Arbeiten Sie vom Router, der dem Datenverkehr zum Kern am nächsten ist. Tragen Sie Ihre Markierung auf die Eingangsschnittstelle des Routers ein. In der folgenden Topologie ist Router A der offensichtliche Ort, um Datenverkehr zu kennzeichnen und Richtlinien für Daten anzuwenden, die von Netzwerk A stammen und für Router B bestimmt sind. Der Datenverkehr wird markiert, sobald er an die Ethernet0-Schnittstelle von Router A ankommt, und die QoS-Richtlinie wird auf die Serial0-Schnittstelle von Router A angewendet, während dieser den Router verlässt. Wenn dieselbe Richtlinie in beide Richtungen angewendet werden soll (sodass der von Netzwerk B stammende und für Netzwerk A bestimmte Datenverkehr dieselbe Behandlung erhält), sollte der Datenverkehr von Netzwerk B gekennzeichnet werden, wenn er in die Ethernet1-Schnittstelle von Router B eingeht und so behandelt wird, als er den Router in der Serial1-Schnittstelle verlässt.

Wenn der Datenverkehr an der Eingangsoberfläche auf einem Router markiert wurde, behält er die gleichen Markierungen bei wie über mehrere Hops (es sei denn, er wird neu markiert). In der Regel muss der Datenverkehr nur einmal markiert werden. Auf Basis dieser Markierungen können QoS-Richtlinien auf zusätzliche Hops angewendet werden. Sie sollten nur dann erneut markieren müssen, wenn der Datenverkehr von einer nicht vertrauenswürdigen Domäne eingeht.

Erstellen von Richtlinien zur Behandlung von Datenverkehr

Nachdem Sie den Datenverkehr markiert haben, können Sie die Markierungen verwenden, um eine Richtlinie zu erstellen und den Datenverkehr in den übrigen Netzwerksegmenten zu klassifizieren. Es wird empfohlen, die Richtlinie einfach zu halten, indem nicht mehr als vier Klassen verwendet werden.

Implementieren und testen Sie möglichst eine QoS-Implementierung in einer Laborumgebung. Sobald Sie mit den Ergebnissen zufrieden sind, können Sie sie im Live-Netzwerk bereitstellen.

Anwenden der Richtlinie

Wenden Sie die Richtlinie in die entsprechende Richtung an. Entscheiden Sie, ob die Richtlinie in eine Richtung oder in beide Richtungen angewendet werden soll. Markieren und behandeln Sie den Datenverkehr immer so nahe wie möglich an der Quelle, wie im Abschnitt Erstellen einer Richtlinie zum Markieren jeder Klasse beschrieben.

Es wird empfohlen, in beide Richtungen dieselben Richtlinien anzuwenden, um den Datenverkehr, der von beiden Seiten der Website eingeht und für beide Seiten bestimmt ist, zu filtern. Das bedeutet, dass Sie die gleiche Richtlinie für ausgehenden Datenverkehr auf die serielle Schnittstelle von RouterA und die serielle Schnittstelle von RouterB anwenden sollten.

Verwenden von QoS Policy Manager (QPM) zur Überwachung der Auswirkungen der Richtlinie

Verwenden Sie QPM als komplettes System für eine zentrale Richtlinienkontrolle und eine automatisierte, zuverlässige Richtlinienbereitstellung.

QoS-Empfehlungen für allgemeine Zwecke

Nachfolgend finden Sie eine Liste der QoS-Kategorien und einige der in den einzelnen Kategorien am häufigsten verwendeten QoS-Funktionen.

| Kategorie | Zugehörige QoS-Funktionen |

|---|---|

| QoS-Servicemodell | Bereitstellung einer (Diffserv-) QoS, wenn möglich, oder ggf. eines signalisierten (RSVP). |

| Klassifizierung/Kennzeichnung | Diffserv-Codepunkte oder QoS-Gruppen-ID. |

| Überlastungsmanagement | LLQ oder CBWFQ. |

| Überlastungsvermeidung | Diffserv-konformes WRED. |

| Verbindungseffizienz | MLPPP, LFI, FRF.11, FRF.12, CRTP |

| Signalisierung | RSVP, QPPB |

| Datenverkehrszustände/Richtlinienvergabe | Class Based Policer und Generic Traffic Shaping (GTS) oder Frame-Relay Traffic Shaping (FRTS). |

| Konfiguration/Überwachung | QPM, Modular QoS Command Line Interface (CLI), QDM |

Feedback

Feedback