Introduzione

Questo documento descrive l'analisi della connettività di rete o della durata del pacchetto per un dominio UCS (Unified Computing System) in modalità Intersight Managed e identifica la connessione interna per i server con i comandi API Explorer e NXOS.

Contributo di Luis Uribe, ingegnere Cisco TAC.

Prerequisiti

Requisiti

Cisco raccomanda la conoscenza dei seguenti argomenti:

- Intersight

- Connettività di rete fisica

- API (Application Programming Interface)

Componenti usati

Le informazioni fornite in questo documento si basano sulle seguenti versioni software e hardware:

- Cisco UCS 6454 Fabric Interconnect, firmware 4.2(1e)

- Server blade UCSB-B200-M5, firmware 4.2(1a)

- SaaS (Intersight software as a service)

Le informazioni discusse in questo documento fanno riferimento a dispositivi usati in uno specifico ambiente di emulazione. Su tutti i dispositivi menzionati nel documento la configurazione è stata ripristinata ai valori predefiniti. Se la rete è operativa, valutare attentamente eventuali conseguenze derivanti dall'uso dei comandi.

Premesse

La connessione tra le interconnessioni Fabric e le vNIC (Virtual Network Interface) viene stabilita tramite circuiti virtuali, denominati VIF (Virtual Interface). Tali file VIF sono bloccati sugli uplink e consentono la comunicazione con la rete upstream

In modalità Intersight Managed non è disponibile alcun comando che esegue il mapping delle interfacce virtuali con ciascun server, ad esempio show service-profile circuit. I comandi API Explorer/NXOS possono essere usati per determinare la relazione dei circuiti interni creati all'interno del dominio UCS.

Esplora API

API Explorer è disponibile dall'interfaccia grafica utente (GUI) di una delle interconnessioni fabric (primaria o subordinata). Una volta effettuato l'accesso alla console, passare a Inventario, selezionare il server e fare clic su Avvia API Explorer.

API Explorer contiene un riferimento API che elenca le chiamate disponibili. Include inoltre un'interfaccia client REST (Reform State Transfer) per testare le chiamate API.

Identificazione VIF tramite chiamate API

È possibile utilizzare un set di chiamate API per determinare quale VIF corrisponde a ciascuna vNIC virtuale. Ciò consente di risolvere in modo più efficace i problemi relativi a NXOS.

Ai fini di questo documento, la navigazione con le chiamate API viene effettuata attraverso questi elementi: Chassis, server, scheda di rete, vNIC/vHBA.

| Chiamata API |

Sintassi |

| OTTIENI ID chassis |

/redfish/v1/Chassis |

| GET Adapter ID |

/redfish/v1/Chassis/{IDchassis}/Schede di rete |

| DETTAGLI GET Network (elenco di vlan/vhba) |

/redfish/v1/Chassis/{IDchassis}/AdattatoriRete/{IDadattatoreRete} |

| GET Funzioni dispositivo di rete (configurazione vNIC) |

/redfish/v1/Chassis/{IDchassis}/NetworkAdapters/{IDschedaRete}/NetworkDeviceFunctions |

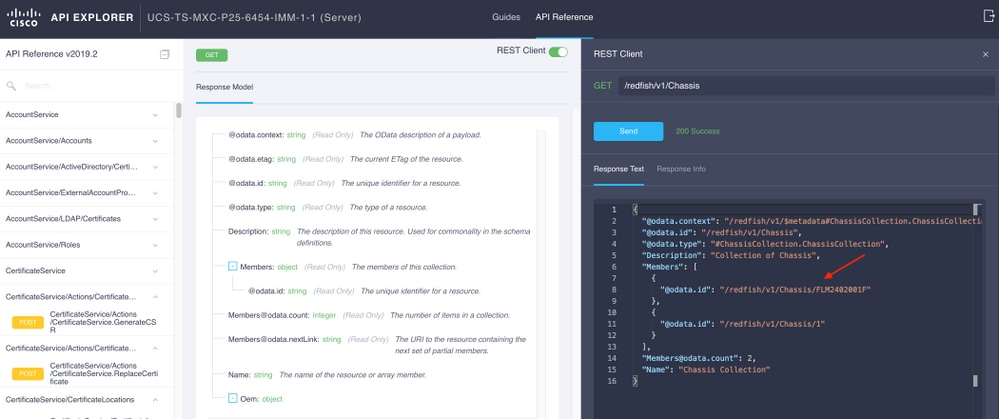

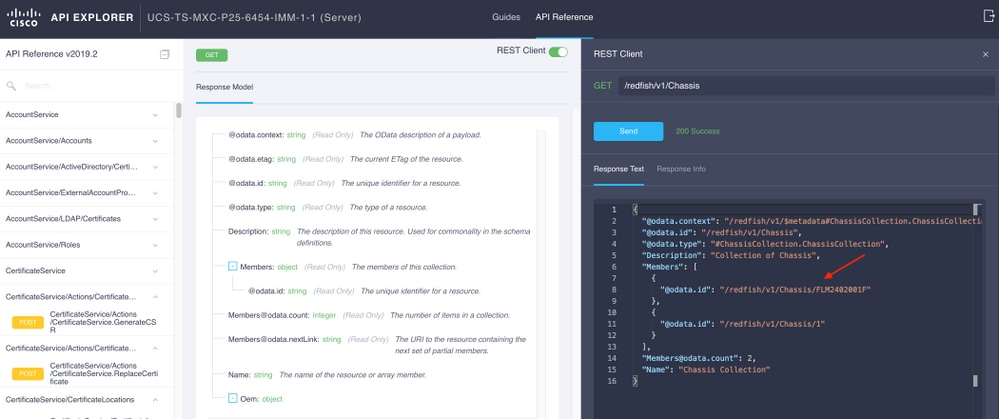

Recupera ID chassis

Copiare l'ID chassis per la chiamata API.

/redfish/v1/Chassis/FLM2402001F

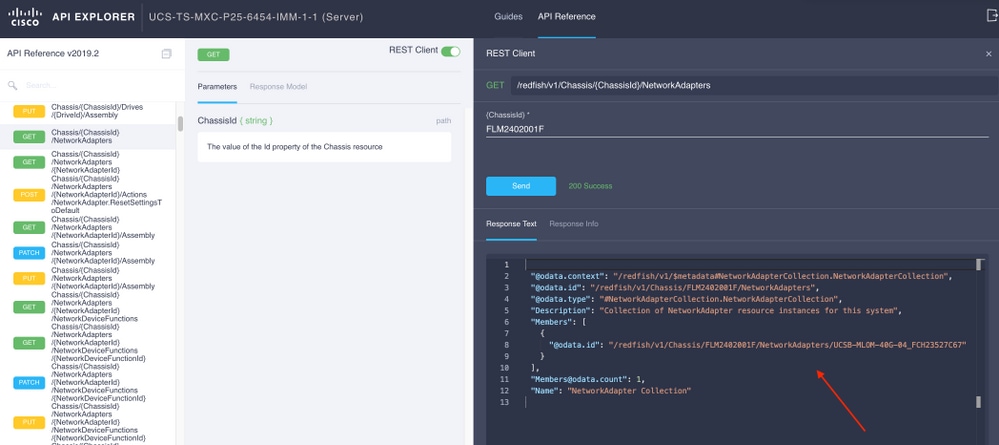

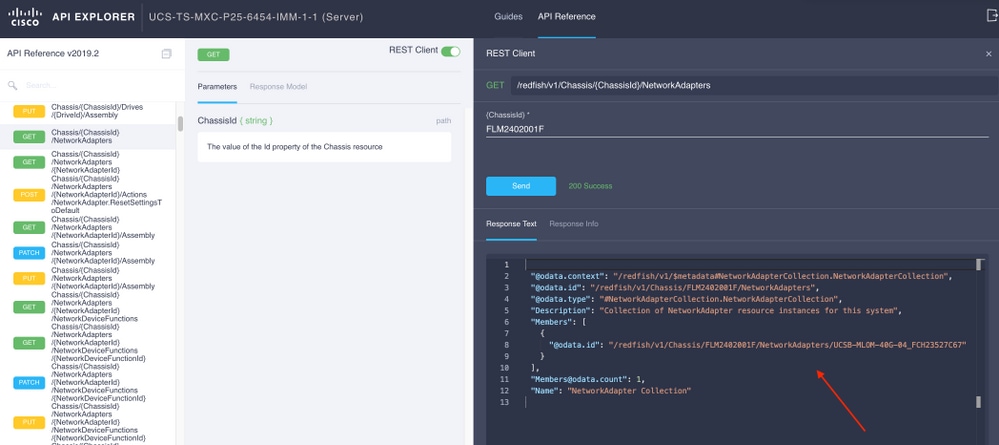

Recupera ID scheda di rete

Copiare l'ID di rete per la chiamata API successiva.

/redfish/v1/Chassis/FLM2402001F/NetworkAdapters/UCSB-MLOM-40G-04_FCH23527C67

Recupera ID vNIC

Copiare l'ID delle schede di rete.

/redfish/v1/Chassis/FLM2402001F/NetworkAdapters/UCSB-MLOM-40G-04_FCH23527C67/NetworkDeviceFunctions/Vnic-A

/redfish/v1/Chassis/FLM2402001F/NetworkAdapters/UCSB-MLOM-40G-04_FCH23527C67/NetworkDeviceFunctions/Vnic-B

Recuperare l'ID VIF della vNIC corrispondente

In questo caso, la scheda vNIC-A è mappata a VIF 800. Da qui, i comandi NXOS contengono questa interfaccia virtuale.

Identificazione di VIF con NXOS e filtri Grep

Se API Explorer non è disponibile o non si ha accesso alla GUI, è possibile usare i comandi CLI per recuperare le informazioni VIF.

Nota: Per utilizzare questi comandi è necessario conoscere il profilo del server.

UCS-TS-MXC-P25-6454-IMM-A(nx-os)# show run interface | grep prev 1 IMM-Server-1

switchport trunk allowed vsan 1

switchport description SP IMM-Server-1, vHBA vhba-a, Blade:FLM2402001F

--

interface Vethernet800

description SP IMM-Server-1, vNIC Vnic-A, Blade:FLM2402001F

--

interface Vethernet803

description SP IMM-Server-1, vNIC Vnic-b, Blade:FLM2402001F

--

interface Vethernet804

description SP IMM-Server-1, vHBA vhba-a, Blade:FLM2402001F

| Sintassi dei comandi |

Utilizzo |

| show run interface | grep prev 1 <nome profilo server> |

Elenca le reti Ethernet associate a ciascuna scheda vNIC/vHBA |

| show run interface | grep prev 1 next 10 <nome profilo server> |

Elenca la configurazione Ethernet dettagliata |

Risoluzione dei problemi NXOS

Una volta che la vNIC è stata mappata alla corrispondente Ethernet, l'analisi può essere eseguita su NXOS con gli stessi comandi utilizzati per risolvere i problemi delle interfacce fisiche.

La notazione per le vNIC è veth - Ethernet.

show interface brief mostra Veth800 in stato inattivo con ENM Source Pin Failure come motivo.

UCS-TS-MXC-P25-6454-IMM-A# connect nxos

UCS-TS-MXC-P25-6454-IMM-A(nx-os)# show interface brief | grep -i Veth800

Veth800 1 virt trunk down ENM Source Pin Fail auto

show interface mostra che Ethernet 800 è in stato initializing.

UCS-TS-MXC-P25-6454-IMM-A(nx-os)# show interface Vethernet 800

Vethernet800 is down (initializing)

Port description is SP IMM-Server-1, vNIC Vnic-A, Blade:FLM2402001F

Hardware is Virtual, address is 0000.abcd.dcba

Port mode is trunk

Speed is auto-speed

Duplex mode is auto

300 seconds input rate 0 bits/sec, 0 packets/sec

300 seconds output rate 0 bits/sec, 0 packets/sec

Rx

0 unicast packets 0 multicast packets 0 broadcast packets

0 input packets 0 bytes

0 input packet drops

Tx

0 unicast packets 0 multicast packets 0 broadcast packets

0 output packets 0 bytes

0 flood packets

0 output packet drops

UCS-TS-MXC-P25-6454-IMM-A(nx-os)# show running-config interface Vethernet 800

!Command: show running-config interface Vethernet800

!Running configuration last done at: Mon Sep 27 16:03:46 2021

!Time: Tue Sep 28 14:35:22 2021

version 9.3(5)I42(1e) Bios:version 05.42

interface Vethernet800

description SP IMM-Server-1, vNIC Vnic-A, Blade:FLM2402001F

no lldp transmit

no lldp receive

no pinning server sticky

pinning server pinning-failure link-down

no cdp enable

switchport mode trunk

switchport trunk allowed vlan 1,470

hardware vethernet mac filtering per-vlan

bind interface port-channel1280 channel 800

service-policy type qos input default-IMM-QOS

no shutdown

Un file VIF deve essere bloccato su un'interfaccia uplink, in questo scenario l'interfaccia show pinning border non visualizza la rete Ethernet bloccata su alcun uplink.

UCS-TS-MXC-P25-6454-IMM-A(nx-os)# show pinning border-interfaces

--------------------+---------+----------------------------------------

Border Interface Status SIFs

--------------------+---------+----------------------------------------

Eth1/45 Active sup-eth1

Eth1/46 Active Eth1/1/33

Ciò significa che gli uplink richiedono una configurazione aggiuntiva. Questo output corrisponde alla configurazione show running di Ethernet Uplink 1/46.

UCS-TS-MXC-P25-6454-IMM-B(nx-os)# show running-config interface ethernet 1/45

!Command: show running-config interface Ethernet1/45

!No configuration change since last restart

!Time: Wed Sep 29 05:15:21 2021

version 9.3(5)I42(1e) Bios:version 05.42

interface Ethernet1/45

description Uplink

pinning border

switchport mode trunk

switchport trunk allowed vlan 69,470

no shutdown

show mac address-table details che Veth800 usa la VLAN 1 che non è presente sugli uplink.

UCS-TS-MXC-P25-6454-IMM-A(nx-os)# show mac address-table

Legend:

* - primary entry, G - Gateway MAC, (R) - Routed MAC, O - Overlay MAC

age - seconds since last seen,+ - primary entry using vPC Peer-Link,

(T) - True, (F) - False, C - ControlPlane MAC, ~ - vsan

VLAN MAC Address Type age Secure NTFY Ports

---------+-----------------+--------+---------+------+----+------------------

* 1 0025.b501.0036 static - F F Veth800

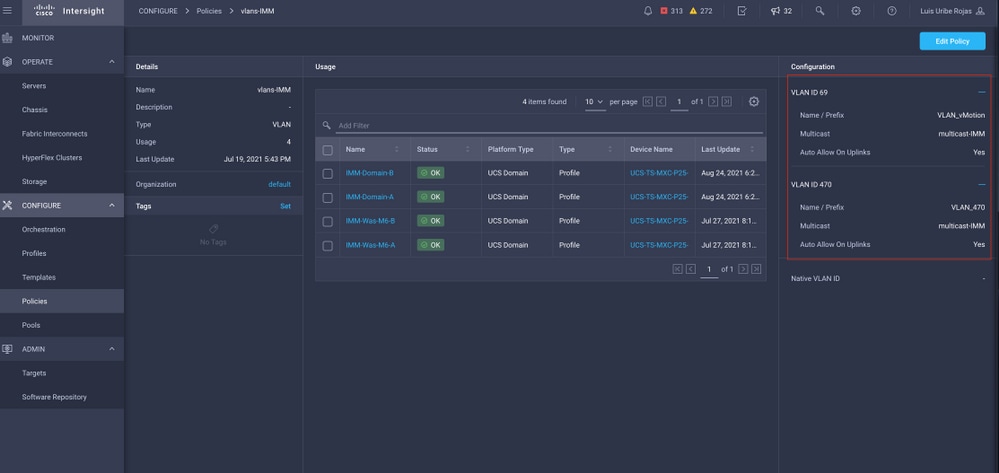

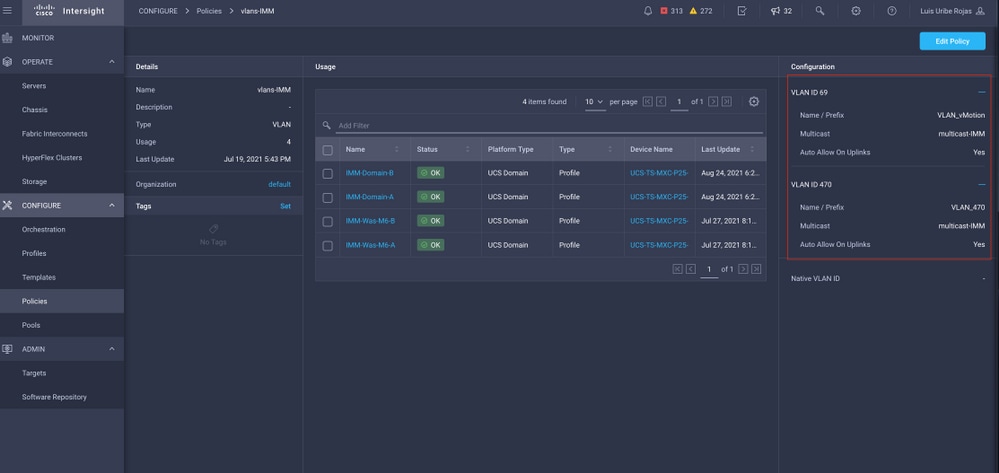

Su un dominio UCS, la VLAN in uso deve essere inclusa anche sulla vNIC e sugli uplink. Il criterio VLAN configura le VLAN sulle interconnessioni dell'infrastruttura. Nell'immagine viene illustrata la configurazione del dominio UCS.

La VLAN 1 non è presente nel criterio, quindi deve essere aggiunta.

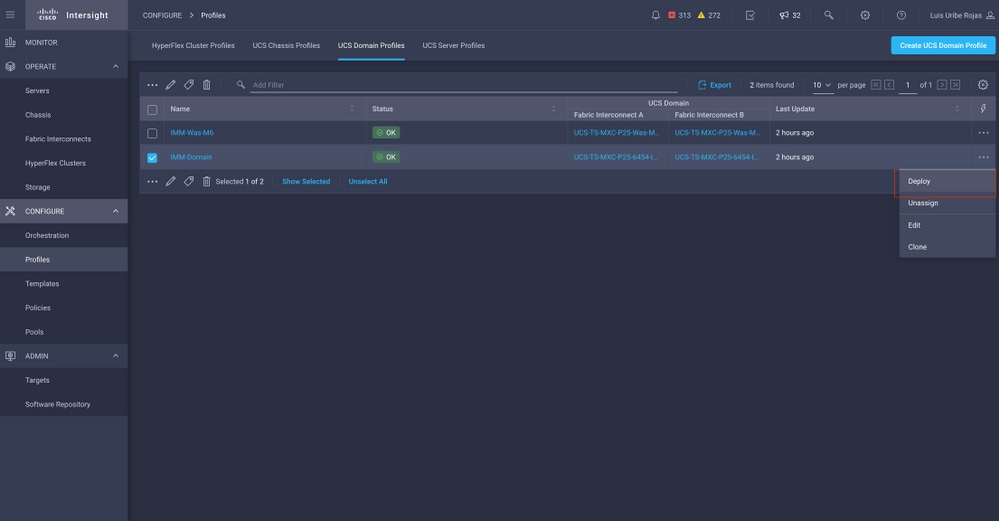

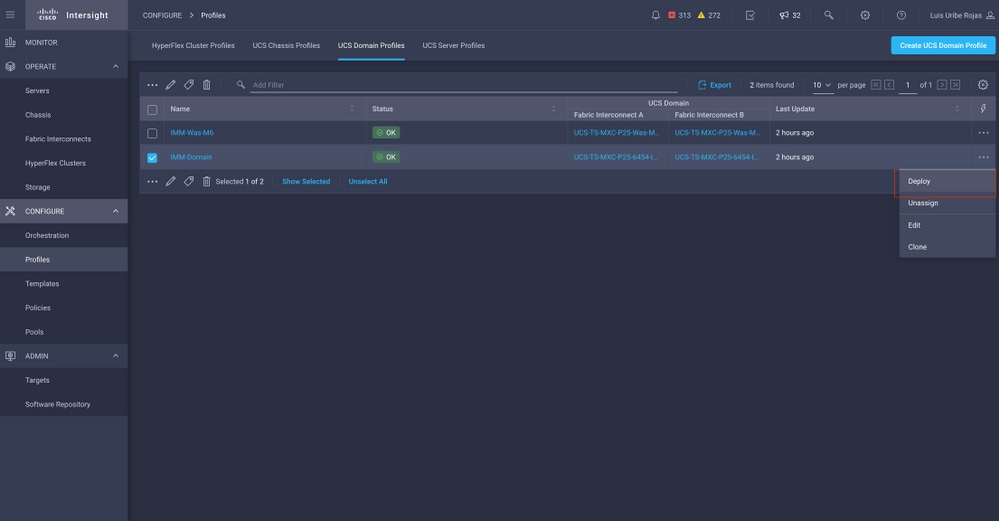

Per consentire la connettività, selezionare Modifica criterio. Questa modifica richiede la distribuzione del profilo di dominio UCS.

L'assegnazione della VLAN può essere verificata dalla CLI:

UCS-TS-MXC-P25-6454-IMM-A(nx-os)# show running-config interface ethernet 1/45

!Command: show running-config interface Ethernet1/45

!Running configuration last done at: Wed Sep 29 07:50:43 2021

!Time: Wed Sep 29 07:59:31 2021

version 9.3(5)I42(1e) Bios:version 05.42

interface Ethernet1/45

description Uplink

pinning border

switchport mode trunk

switchport trunk allowed vlan 1,69,470

udld disable

no shutdown

UCS-TS-MXC-P25-6454-IMM-A(nx-os)#

Dopo aver aggiunto le VLAN necessarie, è possibile usare lo stesso gruppo di comandi per verificare la connettività su Ethernet800:

UCS-TS-MXC-P25-6454-IMM-A(nx-os)# show interface brief | grep -i Veth800

Veth800 1 virt trunk up none auto

UCS-TS-MXC-P25-6454-IMM-A(nx-os)# show interface Vethernet 800

Vethernet800 is up

Port description is SP IMM-Server-1, vNIC Vnic-A, Blade:FLM2402001F

Hardware is Virtual, address is 0000.abcd.dcba

Port mode is trunk

Speed is auto-speed

Duplex mode is auto

300 seconds input rate 0 bits/sec, 0 packets/sec

300 seconds output rate 0 bits/sec, 0 packets/sec

Rx

0 unicast packets 1 multicast packets 6 broadcast packets

7 input packets 438 bytes

0 input packet drops

Tx

0 unicast packets 25123 multicast packets 137089 broadcast packets

162212 output packets 11013203 bytes

0 flood packets

0 output packet drops

UCS-TS-MXC-P25-6454-IMM-A(nx-os)# show running-config interface Vethernet 800

!Command: show running-config interface Vethernet800

!Running configuration last done at: Wed Sep 29 07:50:43 2021

!Time: Wed Sep 29 07:55:51 2021

version 9.3(5)I42(1e) Bios:version 05.42

interface Vethernet800

description SP IMM-Server-1, vNIC Vnic-A, Blade:FLM2402001F

no lldp transmit

no lldp receive

no pinning server sticky

pinning server pinning-failure link-down

switchport mode trunk

switchport trunk allowed vlan 1,69,470

hardware vethernet mac filtering per-vlan

bind interface port-channel1280 channel 800

service-policy type qos input default-IMM-QOS

no shutdown

Veth800 è elencato sulle interfacce bloccate alle interfacce Ethernet uplink:

UCS-TS-MXC-P25-6454-IMM-A(nx-os)# show pinning border-interfaces

--------------------+---------+----------------------------------------

Border Interface Status SIFs

--------------------+---------+----------------------------------------

Eth1/45 Active sup-eth1 Veth800 Veth803

Eth1/46 Active Eth1/1/33

Total Interfaces : 2

UCS-TS-MXC-P25-6454-IMM-A(nx-os)#

I file VIF sono ora pronti per trasmettere il traffico alla rete a monte.

Informazioni correlate

Feedback

Feedback