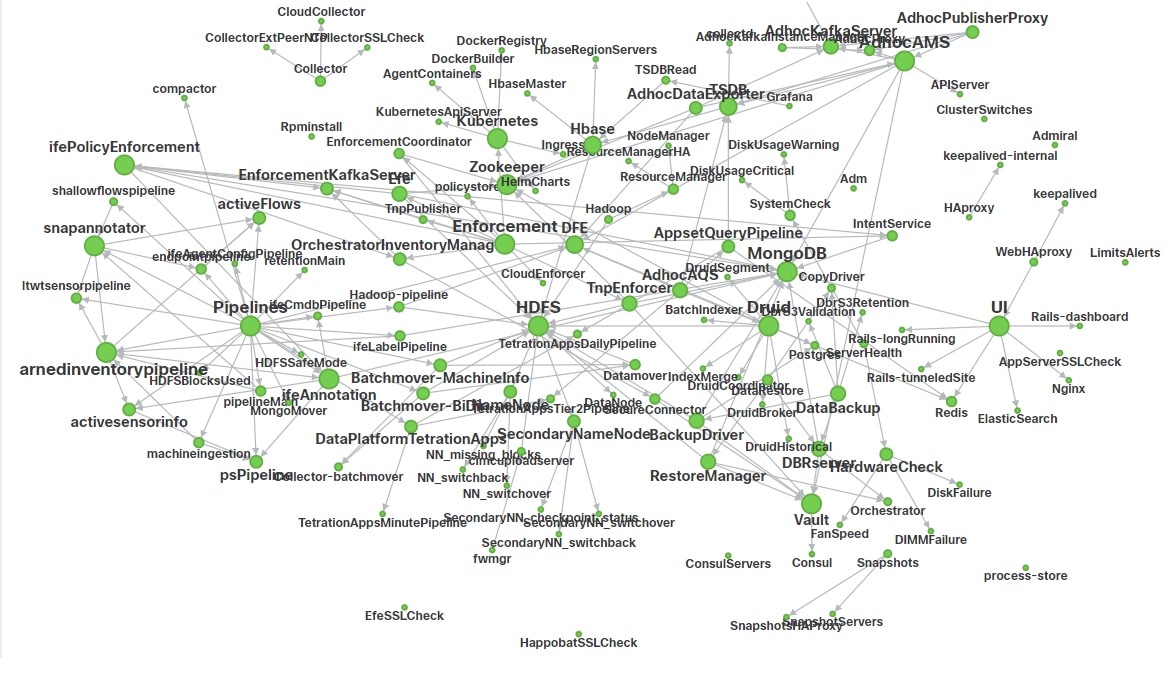

État du service

Dans le volet de navigation de gauche, la page affiche l’intégrité de tous les services utilisés dans votre grappe Cisco Cisco Secure Workload ainsi que leurs dépendances.

Dans le cadre de la documentation associée à ce produit, nous nous efforçons d’utiliser un langage exempt de préjugés. Dans cet ensemble de documents, le langage exempt de discrimination renvoie à une langue qui exclut la discrimination en fonction de l’âge, des handicaps, du genre, de l’appartenance raciale de l’identité ethnique, de l’orientation sexuelle, de la situation socio-économique et de l’intersectionnalité. Des exceptions peuvent s’appliquer dans les documents si le langage est codé en dur dans les interfaces utilisateurs du produit logiciel, si le langage utilisé est basé sur la documentation RFP ou si le langage utilisé provient d’un produit tiers référencé. Découvrez comment Cisco utilise le langage inclusif.

Cisco peut fournir des traductions du présent contenu dans la langue locale pour certains endroits. Veuillez noter que des traductions sont fournies à titre informatif seulement et, en cas d’incohérence, la version anglaise du présent contenu prévaudra.

Ce chapitre fournit des détails sur les diverses actions de maintenance de la grappe que vous pouvez effectuer, telles que la mise à niveau, le redémarrage, la planification de sauvegardes de données et la restauration de données. Vous pouvez également afficher l’état du service et de la grappe à partir des options disponibles dans le menu de dépannage.

Dans le volet de navigation de gauche, la page affiche l’intégrité de tous les services utilisés dans votre grappe Cisco Cisco Secure Workload ainsi que leurs dépendances.

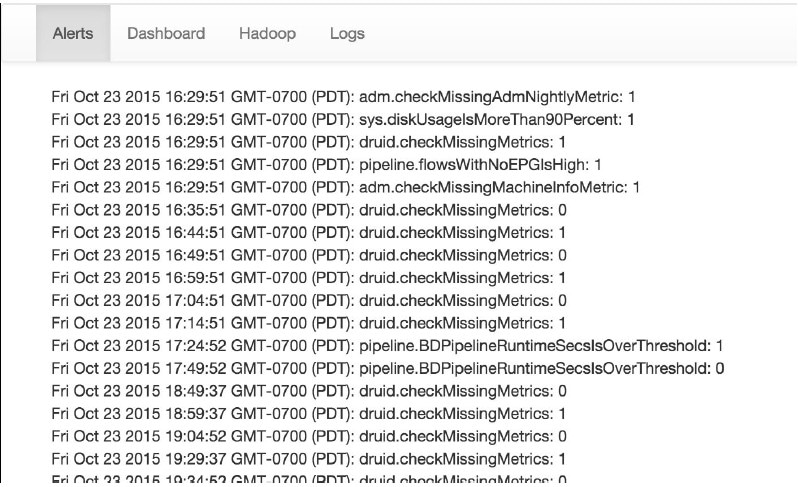

Admiral est un système d’alerte intégré. Il traite les alertes en fonction de l’intégrité du service signalée par le Service Status (État du service). Ainsi, les utilisateurs disposent d’un moyen unifié de déterminer l’intégrité d’un service ou de la grappe. L’état du service affiche l’intégrité actuelle (à un moment donné) d’un service. Le service est considéré comme en panne lorsqu’il indique l’état du service en rouge, sinon il est considéré comme activé. La disponibilité est le moment où le service est signalé comme opérationnel. Admiral évalue l’intégrité du service signalée par état de service au fil du temps et déclenche une alerte si le pourcentage de disponibilité du service tombe sous un certain seuil. Cette évaluation sur une certaine durée garantit que nous réduisons les faux positifs et que nous alertons uniquement en cas de pannes de service réelles.

Comme les services ont des besoins en alertes différents, ce pourcentage et cet intervalle de temps sont fixés différemment pour chaque service.

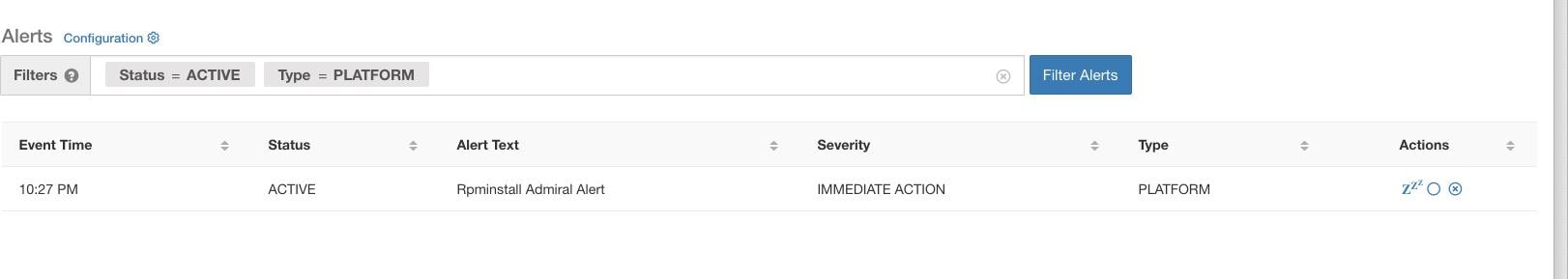

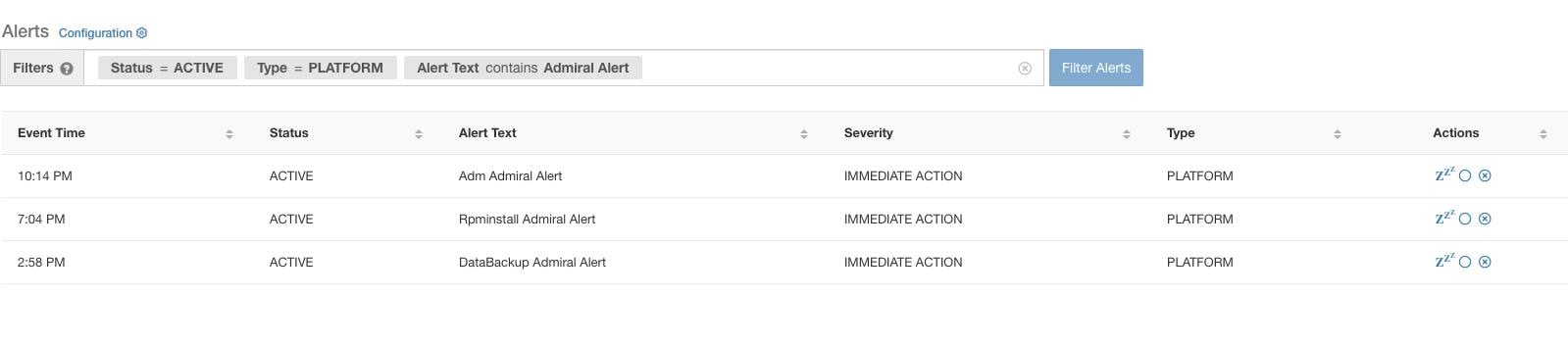

Les clients peuvent utiliser les notifications Admiral pour être informés de ces événements. Elles sont également visibles sur la page , sous le type PLATFORM (PLATEFORME).

Note |

Seul un sous-ensemble de services choisi est associé à une alerte Admiral. Si un service ne fait pas partie du sous-ensemble ci-dessus, aucune alerte Admiral ne sera déclenchée lors de sa panne. Ce sous-ensemble de services avec alertes Admiral, leurs pourcentages de seuil d'alerte et leurs intervalles de temps est fixe et n'est pas configurable par l'utilisateur. |

Les sections suivantes décrivent plus en détail les alertes et les notifications Admiral.

L’Admiral vérifie la disponibilité des services sur l'état des services. Il déclenche une alerte lorsque ce temps de disponibilité devient inférieur au seuil d’alerte préconfiguré.

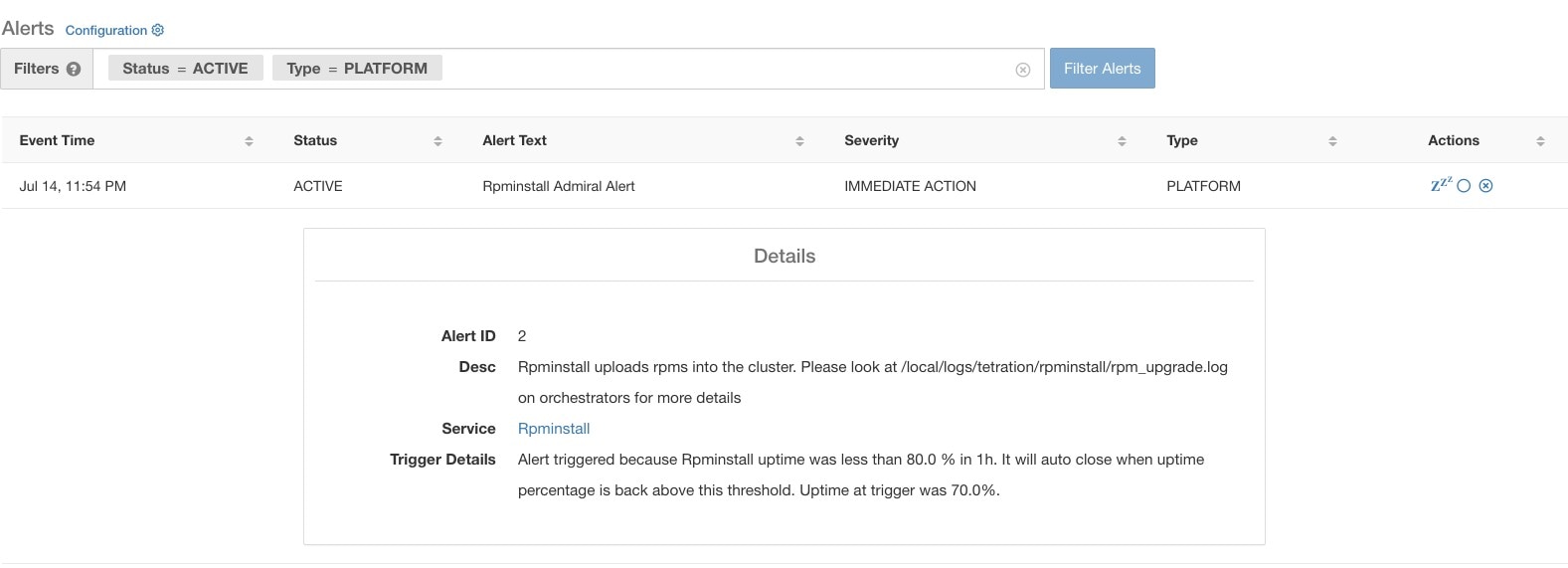

Par exemple, Rpminstall est un service utilisé pour installer les RPM lors des déploiements, des mises à niveau, des correctifs, etc. Il est configuré pour générer une alerte Admiral si son temps de disponibilité est inférieur à 80 % sur une heure. Si le service Rpminstall tombe en panne pendant une durée supérieure au seuil précisé ci-dessus, une alerte Admiral est générée pour Rpminstall avec l’état ACTIVE.

Lorsque le service se rétablit, son pourcentage de disponibilité commence à augmenter. Lorsque la disponibilité dépasse son seuil, l’alerte se ferme automatiquement et son état passe à CLOSED (FERMÉE). Dans l’exemple Rpminstall décrit ci-dessus, RpminstallAdmiral Alert se ferme automatiquement lorsque son temps de disponibilité dépasse 80 % en une heure.

Note |

La fin de l'alerte est TOUJOURS décalée par rapport au retour à la normale du service. En effet, Admiral examine l’intégrité du service sur une période donnée. Dans l’exemple ci-dessus, puisque le seuil d’alerte Rpminstall est défini à 80 % d’une heure de disponibilité, il doit l’être depuis au moins 48 minutes (80 % d’une heure) avant que l’alerte ne se ferme. |

Aucune action n’est requise pour fermer l’alerte. Ainsi, toutes les alertes Admiral ACTIVENT indiquent un problème sous-jacent nécessitant notre attention.

Note |

Aucune notification dédiée n’est générée à la fermeture des alertes. |

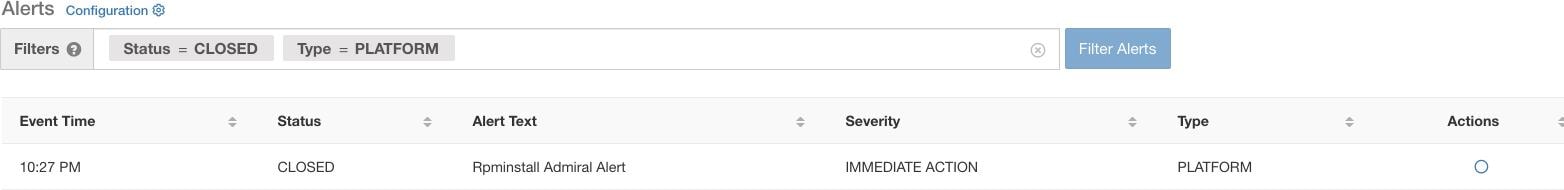

Après qu’une alerte soit passée à FERMÉE, elle ne s’affichera plus sous les alertes ACTIVES. Les alertes fermées peuvent toujours être vues sur l’interface utilisateur en utilisant le filtre Status=CLOSED comme indiqué ci-dessous :

Il existe deux types d’alertes Admiral :

Les alertes décrites dans la section précédente, les alertes qui sont déclenchées pour des services individuels, appartiennent à la catégorie d’alerte individuelle Admiral. Le texte de l’alerte contient toujours l <Service Name> de l'alerte Admiral. Cela facilite le filtrage des alertes individuelles par service ou par le suffixe Admiral Alert.

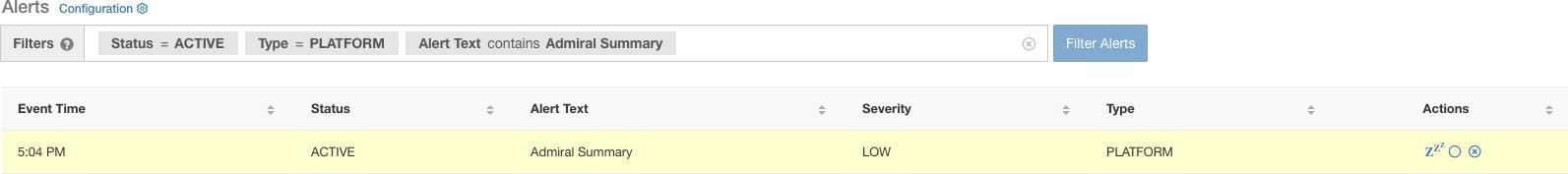

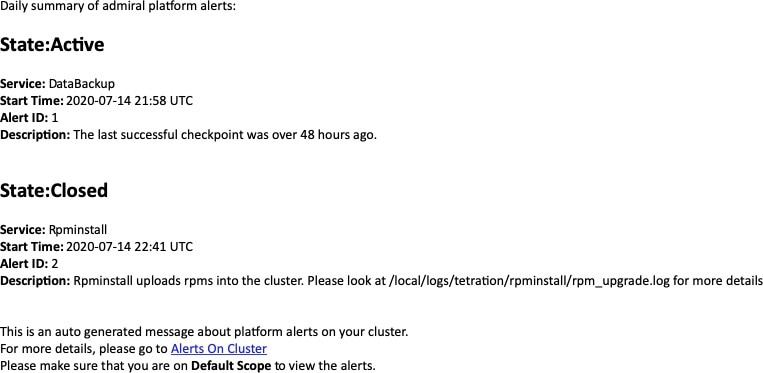

Admiral génère des alertes résumées quotidiennement à minuit UTC. Elles contiennent une liste des alertes actuellement actives et de toutes les alertes fermées au cours de la dernière journée. Cela permet à l’utilisateur de voir l’intégrité globale de la grappe signalée par Admiral en un seul endroit. C’est également utile pour constater les alertes fermées qui ne génèrent pas de notification dédiée autrement. Si la grappe est intègre et qu’aucune alerte n’a été fermée au cours de la dernière journée, aucune notification récapitulative n’est générée pour ce jour-là. Cela sert à réduire les notifications et le bruit informationnel inutiles.

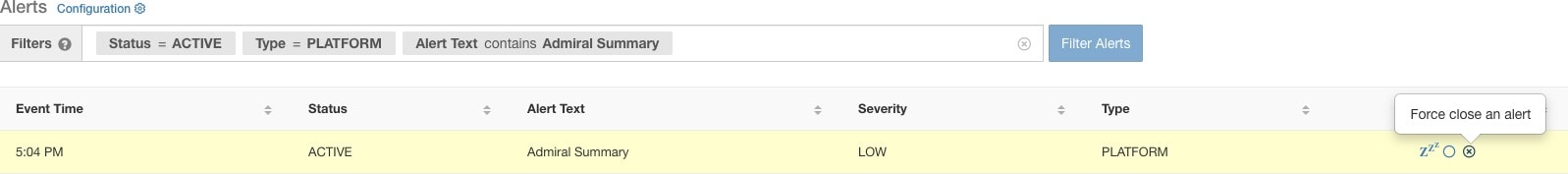

Le texte des alertes, dans ce cas, est toujours « Admiral Summary » . Cela facilite le filtrage des alertes résumées, comme le montre la figure suivante.

Lorsque l'on clique sur l'alerte pour une alerte de type Admiral, celle-ci se déploie pour afficher des champs utiles au débogage et à l'analyse de l'alerte.

|

Champ |

Description |

|---|---|

|

ID d’alerte |

Identifiant unique pour les alertes. Cela permet d'identifier un cas particulier de défaillance d'un service. Comme indiqué précédemment, lorsque le temps de fonctionnement sous-jacent du service signalé par l'alerte devient normal, l'alerte se ferme automatiquement. Si le même service tombe en panne ensuite, une nouvelle alerte avec un ID d’alerte différent est générée. L'identifiant de l'alerte permet donc d'identifier chaque cas de déclenchement de l'alerte. |

|

Desc |

Le champ de description contient des renseignements supplémentaires sur le problème de service à l’origine de l’alerte. |

|

Service |

Celui-ci contient un lien conduisant l’utilisateur à la page d’état du service où ce dernier peut être consulté. L’utilisateur peut également obtenir plus de détails sur les raisons pour lesquelles le service est signalé dans la page d’état du service. |

|

Détails du déclencheur |

Ceci contient les détails sur les seuils de déclenchement pour le service. Ces seuils permettent à l'utilisateur de savoir à quel moment l'alerte doit être clôturée après le rétablissement du service sous-jacent. Par exemple, le seuil RPMinstall est indiqué comme suit : 80 % de disponibilité sur une heure. Par conséquent, le service RPMinstall doit être actif depuis au moins 48 minutes (80 % d’une heure) avant que l’alerte ne se ferme automatiquement. Cela affiche également la valeur de disponibilité observée pour le service lorsque l’alerte a été déclenchée. |

Voici un exemple de sortie de Kafka JSON :

{

"severity": "IMMEDIATE_ACTION",

"tenant_id": 0,

"alert_time": 1595630519423,

"alert_text": "Rpminstall Admiral Alert",

"key_id": "ADMIRAL_ALERT_5",

"alert_id": "/Alerts/5efcfdf5497d4f474f1707c2/DataSource{location_type='TETRATION', location_name='platform', location_grain='MIN', root_scope_id='5efcfdf5497d4f474f1707c2'}/66eb975f5f987fe9eaefa81cee757c8b6dac5facc26554182d8112a98b35c4ab",

"root_scope_id": "5efcfdf5497d4f474f1707c2",

"type": "PLATFORM",

"event_time": 1595630511858,

"Check /local/logs/tetration/rpminstall/rpm_upgrade.log on

orchestrators for more details\",\"Trigger Details\":\"Alert triggered because Rpminstall

uptime was less than 80.0 % in 1h. It will auto close when uptime percentage is back above

this threshold. Uptime at trigger was 65.0%. \"}"

}

Toutes les alertes individuelles respectent le format JSON Kafka. Les services (à partir de l’état du service) qui sont couverts par la surveillance Admiral sont énumérés dans le tableau suivant :

|

Service |

Conditions de déclenchement |

Gravité |

|---|---|---|

|

Serveur API Kubernetes |

La disponibilité du service est inférieure à 90 % au cours des 15 dernières minutes |

ACTION IMMÉDIATE |

|

Administrateur |

La disponibilité du service est inférieure à 90 % au cours de la dernière heure. |

ACTION IMMÉDIATE |

|

Sauvegarde des données |

La disponibilité du service est inférieure à 90 % au cours des 6 dernières heures. |

ACTION IMMÉDIATE |

|

Utilisation disque critique |

La disponibilité du service est inférieure à 80 % au cours de la dernière heure. |

ACTION IMMÉDIATE |

|

Redémarrage requis |

La disponibilité du service est inférieure à 90 % au cours de la dernière heure. |

ACTION IMMÉDIATE |

|

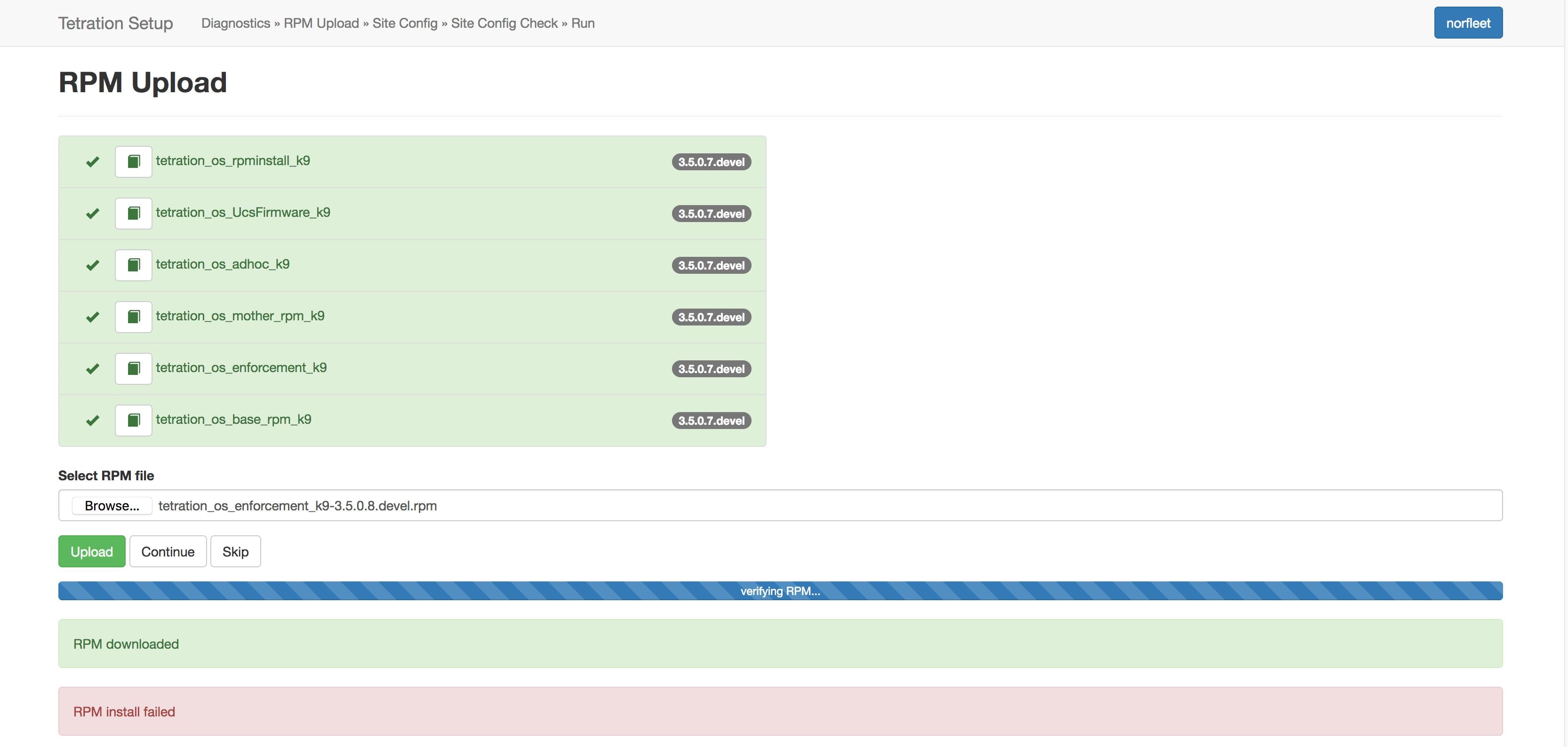

RPMinstall |

La disponibilité du service est inférieure à 80 % au cours de la dernière heure. |

ACTION IMMÉDIATE |

|

SecondaryNN_checkpoint_status |

La disponibilité du service est inférieure à 90 % au cours de la dernière heure. |

ACTION IMMÉDIATE |

Pour les grappes physiques de 8 ou 39 RU, les services suivants sont également surveillés :

|

Service |

Conditions de déclenchement |

Gravité |

|---|---|---|

|

Échec DIMM |

La disponibilité du service est inférieure à 80 % au cours de la dernière heure. |

ACTION IMMÉDIATE |

|

Échec de disque |

La disponibilité du service est inférieure à 80 % au cours de la dernière heure. |

ACTION IMMÉDIATE |

|

Vitesse du ventilateur |

La disponibilité du service est inférieure à 80 % au cours de la dernière heure. |

ACTION IMMÉDIATE |

|

Commutateurs en grappe |

La disponibilité du service est inférieure à 80 % au cours de la dernière heure. |

ACTION IMMÉDIATE |

Note |

La surveillance Admiral s’appuie sur les mesures de traitement générées par l’état du service pour générer des alertes. Si la récupération de la mesure n’est pas possible pendant une durée prolongée (par exemple, si l’état du service est en panne), une alerte (TSDBOracleConnectivity) est déclenchée pour indiquer que le traitement des alertes en fonction du service est désactivé sur la grappe. |

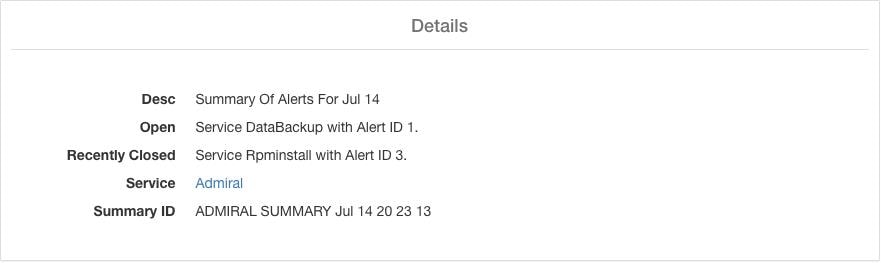

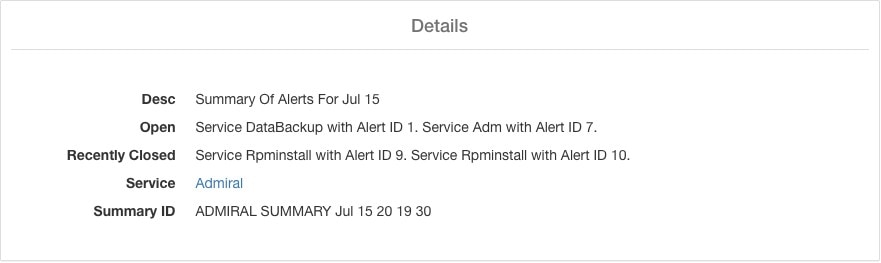

Les alertes résumées sont de nature informationnelle et sont toujours définies comme de priorité FAIBLE. Lorsque l'on clique sur un résumé d'alerte Admiral, celui-ci se développe pour afficher divers champs contenant des informations résumées sur les alertes Admiral.

|

Champ |

Description |

|---|---|

|

Desc |

Le champ de description contient le jour du résumé quotidien. |

|

Ouvert |

Les alertes ouvertes indiquent quelles alertes étaient actives lorsque le résumé a été généré. |

|

Fermées récemment |

Ceci contient les alertes fermées au cours des dernières 24 heures, c’est-à-dire au cours de la journée pour laquelle le résumé a été généré. L’ID de chaque alerte est également inclus. Étant donné que les alertes se ferment automatiquement, un service donné a pu tomber en panne et créer une alerte, puis revenir à la normale et l'alerte se fermer automatiquement. Il aurait pu le faire plusieurs fois par jour, auquel cas la liste des incidents récemment clôturés comprendra chaque incident ainsi que son numéro d'alerte unique. Toutefois, cela ne devrait pas se produire souvent étant donné que chaque service doit être opérationnel pendant un certain temps avant que l'alerte ne soit clôturée. L’utilisateur peut filtrer avec Status = CLOSED pour obtenir plus d’informations sur chaque incident. |

|

Service |

Lien vers l’état du service pour Admiral, qui est le service qui traite et génère le résumé quotidien. |

|

ID du résumé |

ID de l’alerte résumée. |

Voici un exemple de sortie de Kafka JSON :

{

"severity": "LOW",

"tenant_id": 0,

"alert_time": 1595721914808,

"alert_text": "Admiral Summary",

"key_id": "ADMIRAL_SUMMARY_Jul-26-20-00-04",

"alert_id": "/Alerts/5efcfdf5497d4f474f1707c2/DataSource{location_type='TETRATION', location_name='platform', location_grain='MIN', root_scope_id='5efcfdf5497d4f474f1707c2'}/e95da4521012a4789048f72a791fb58ab233bbff63e6cbc421525d4272d469aa",

"root_scope_id": "5efcfdf5497d4f474f1707c2",

"type": "PLATFORM",

"event_time": 1595721856303,

"alert_details": "{\"Desc\":\"Summary of alerts for Jul-26\",\"Recently Closed\":\"None\",\"Open\":\" Service Rpminstall with Alert ID 5.\",\"Service\":\"Admiral\",\"Summary ID\":\"ADMIRAL_SUMMARY_Jul-26-20-00-04\"}"

}

Un exemple d’alerte résumée dans laquelle un service déclenche plusieurs alertes dans une journée est présenté ci-dessous :

Puisque les alertes Admiral ne génèrent qu’une seule notification par alerte, l’inclusion, l’exclusion ou la répétition d’alertes précises ne sont pas nécessaires. Les alertes se ferment automatiquement lorsque le service redevient normal pour le seuil de disponibilité, comme décrit ci-dessus. Il existe la possibilité de forcer la fermeture d'une alerte. Normalement, cela ne doit être utilisé que pour supprimer les récapitulatifs des alertes de l’interface utilisateur, car les alertes individuelles se ferment automatiquement.

Warning |

Les alertes individuelles ne doivent pas être fermées de force. Si vous le faites alors que le service sous-jacent est toujours en panne ou que son temps de fonctionnement est inférieur au seuil prévu, une autre alerte sera déclenchée pour le même service lors de la prochaine itération du traitement Admiral. |

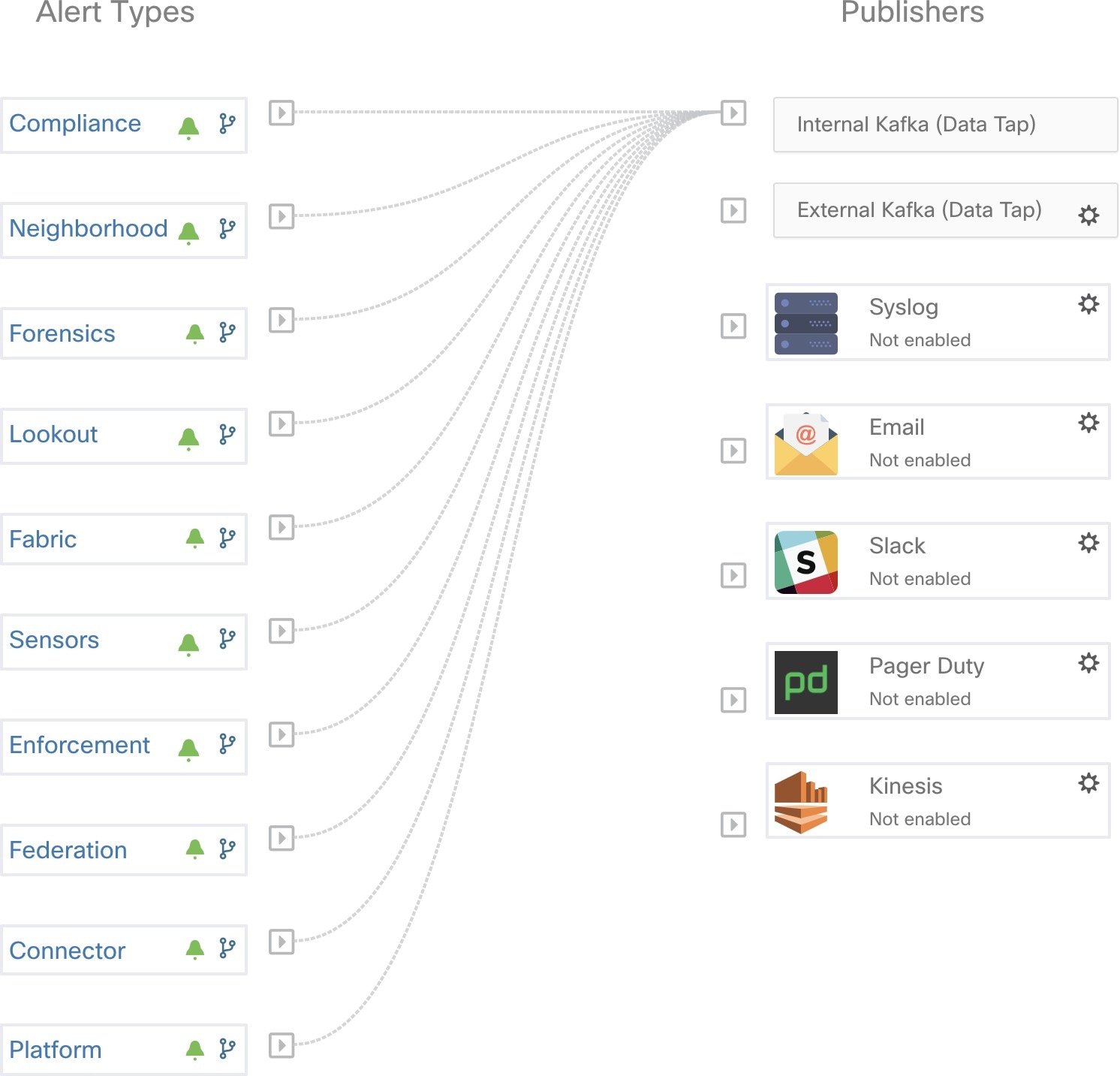

Les alertes Admiral sont de type PLATFORM. De ce fait, ces alertes peuvent être configurées pour être envoyées à divers annonceurs par les connexions appropriées pour les alertes de plateforme à l’aide de la page de configuration ./configuration. Pour plus de commodité, la connexion est activée entre les alertes de la plateforme et le Kafka interne par défaut, ce qui permet d’afficher les alertes Admiral sur la page Alertes actuelles (aller à ) sans aucune configuration manuelle.

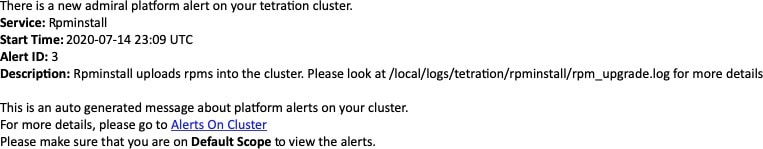

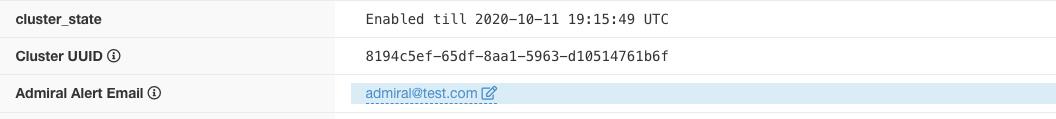

Les alertes Admiral sont également envoyées à l’adresse courriel configurée sous .

Ainsi, les utilisateurs peuvent recevoir des notifications Admiral même s’ils n’ont pas configuré l’appareil TAN Edge. Ce comportement est similaire au comportement du Bosun (maître d’exploitation) dans les versions précédentes.

Ces notifications par courriel sont générées sur les mêmes déclencheurs que la page Current Alerts (Alertes actuelles). Ainsi, elles sont envoyées lors de la création de l’alerte et lors d'un courriel récapitulatif quotidien à minuit UTC. Le courriel récapitulatif quotidien répertorie toutes les alertes actives et celles fermées au cours des dernières 24 heures.

S’il n’y a aucune alerte active, ni aucune alerte fermée au cours des dernières 24 heures, les courriels récapitulatifs sont ignorés pour réduire le bruit des courriels.

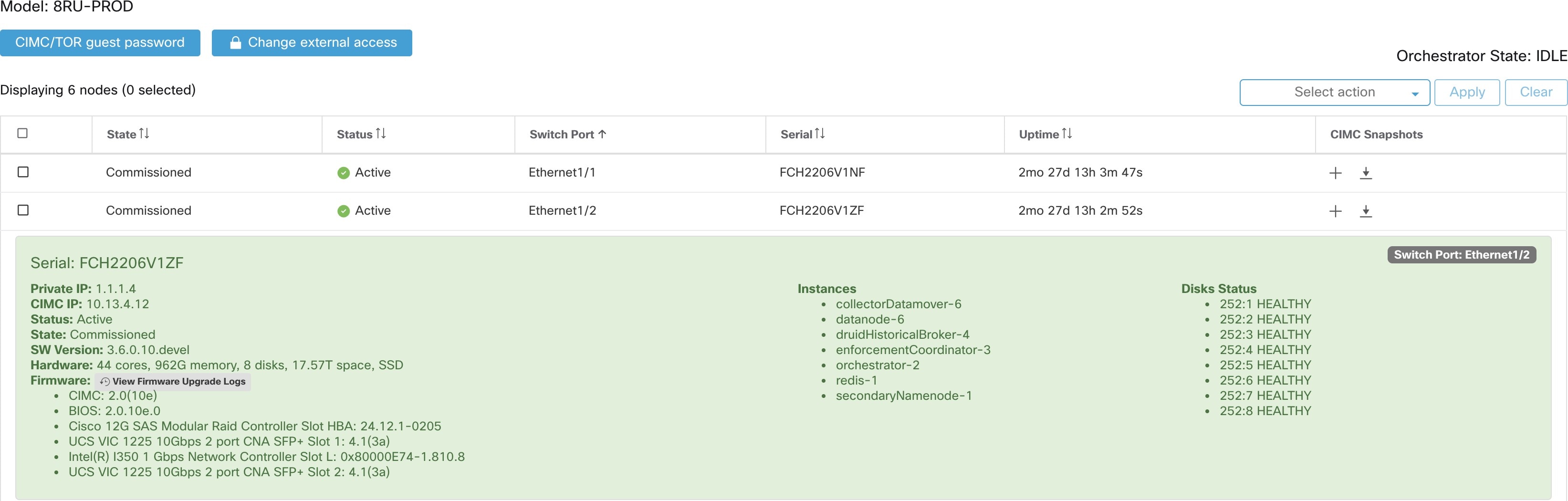

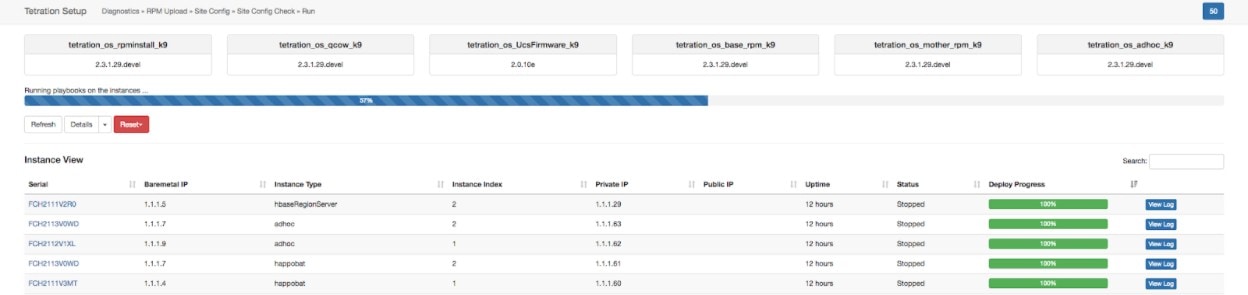

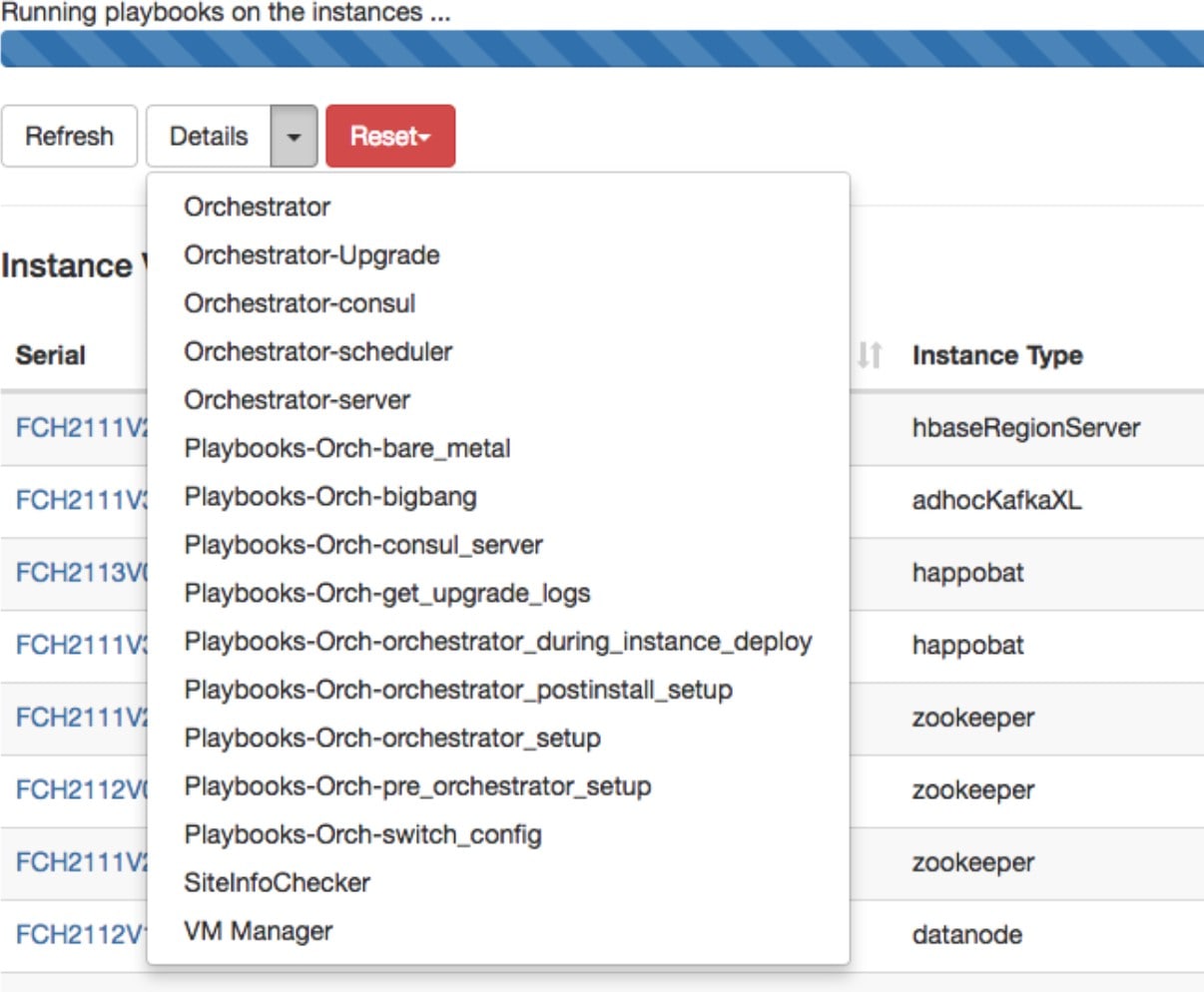

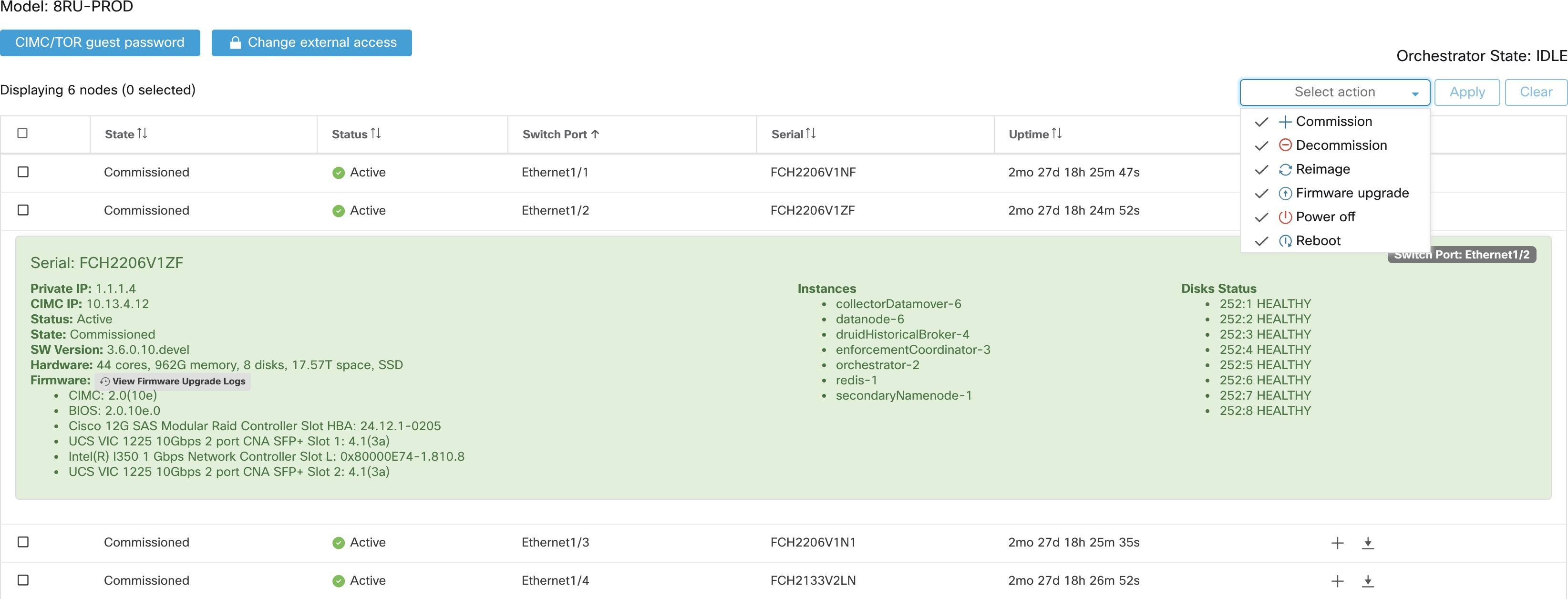

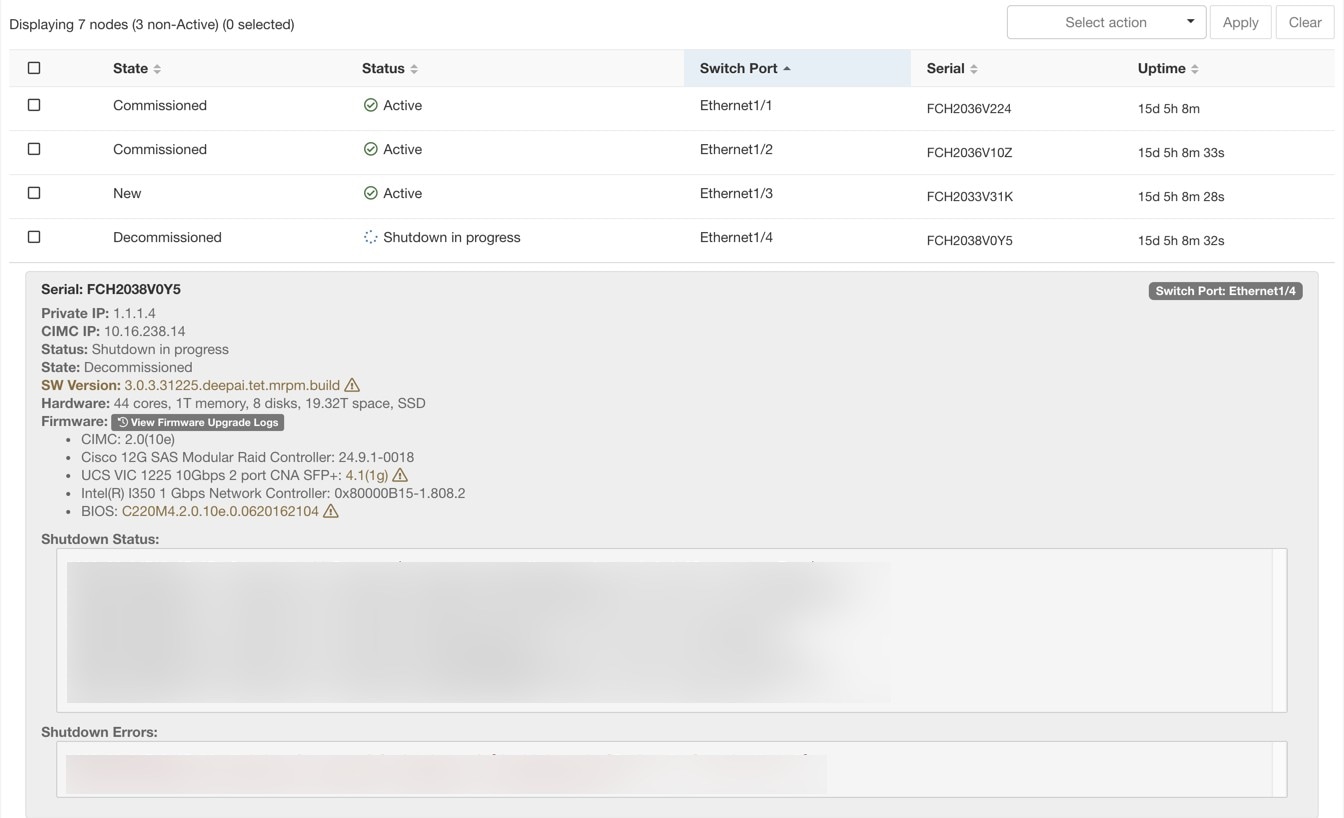

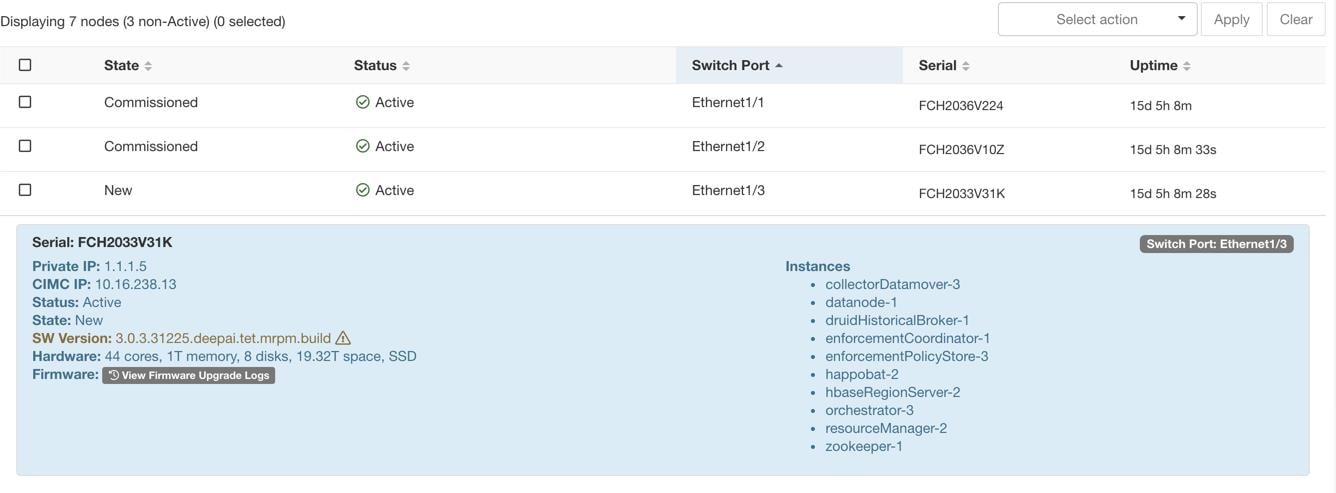

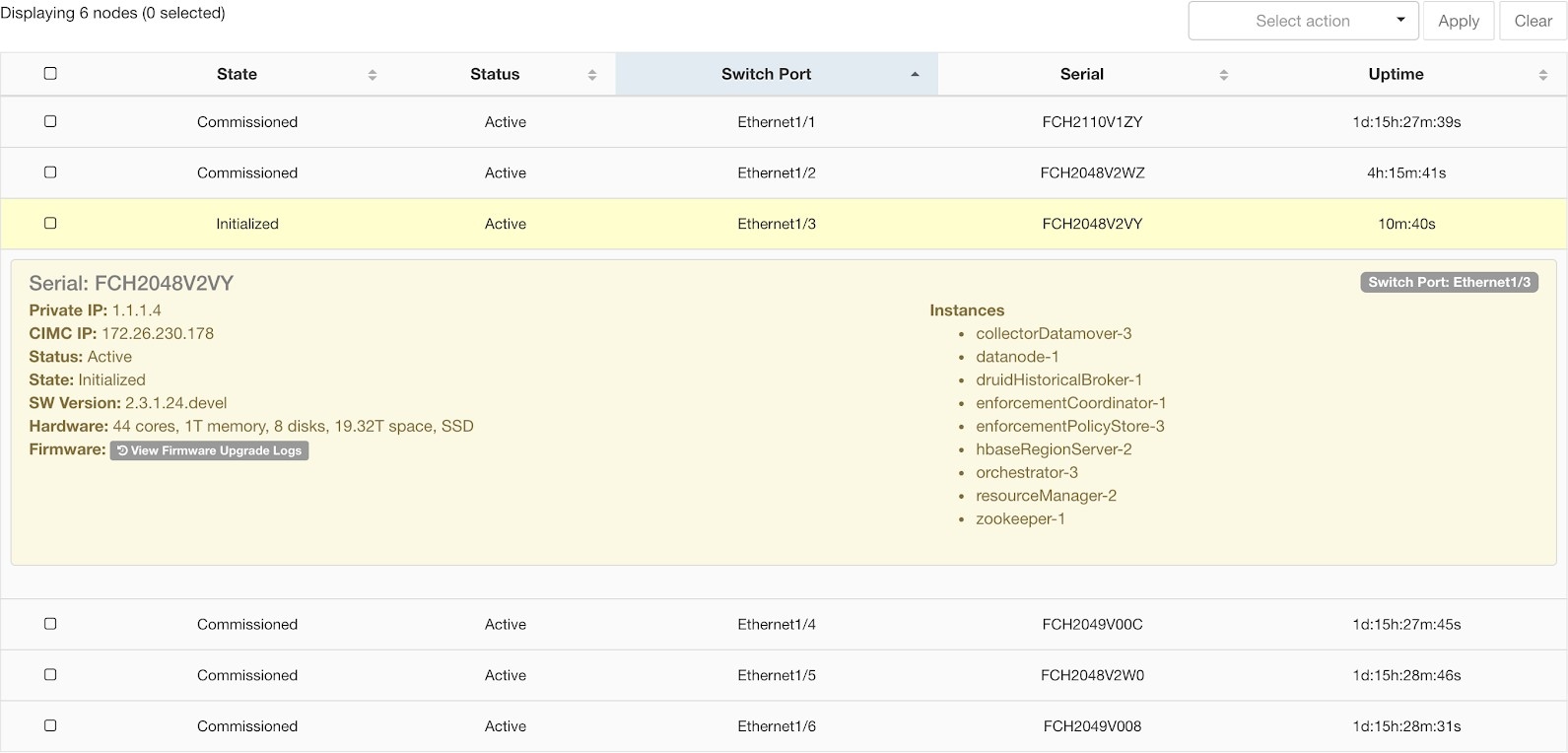

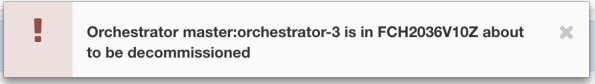

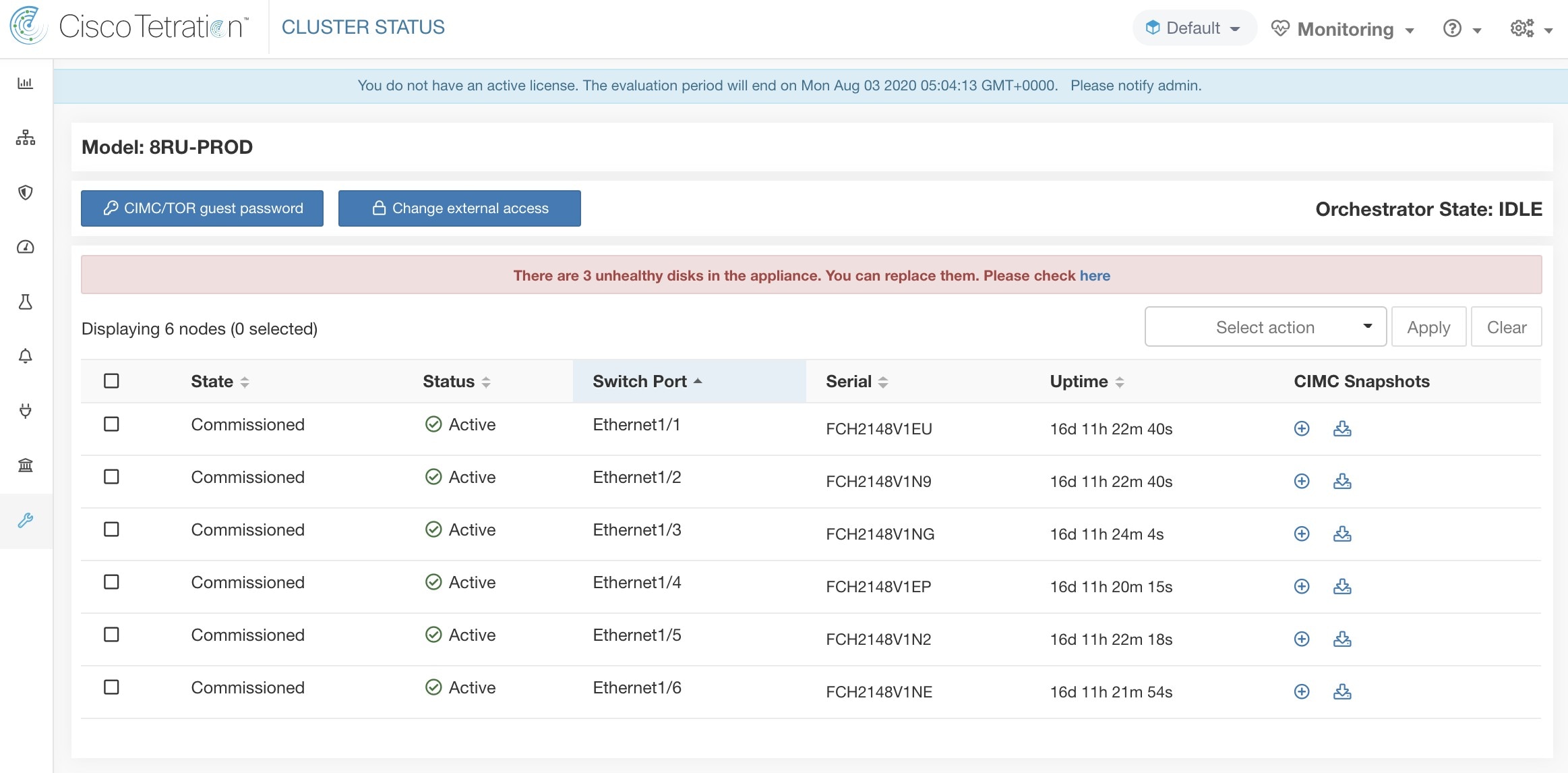

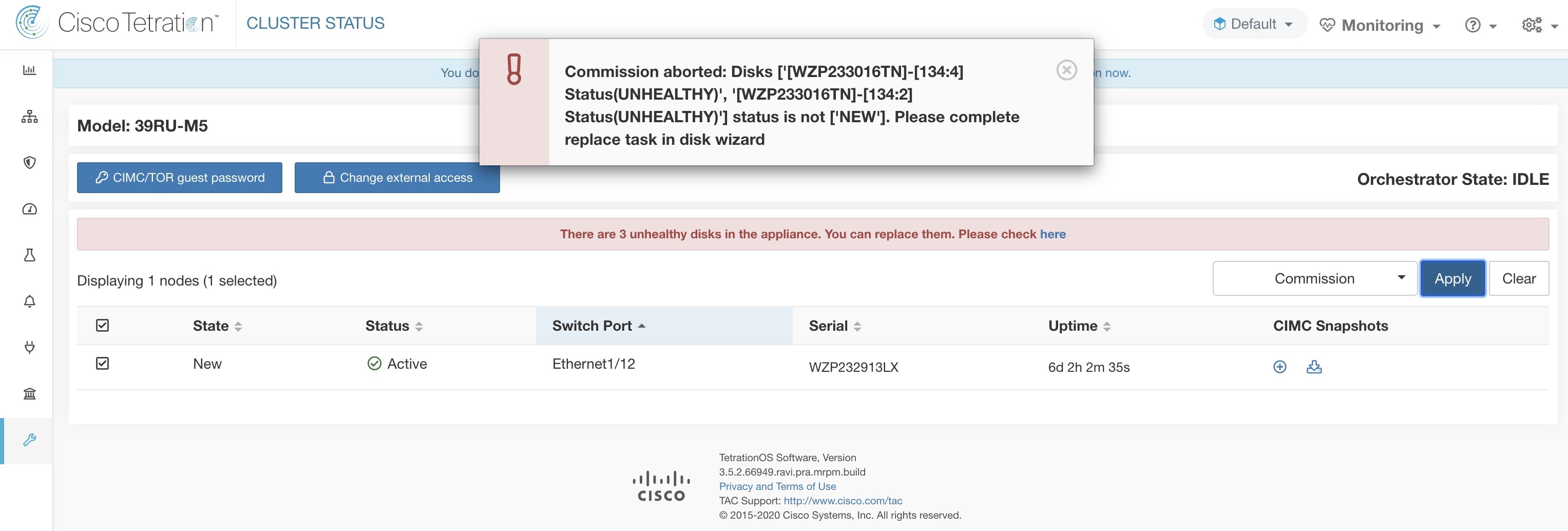

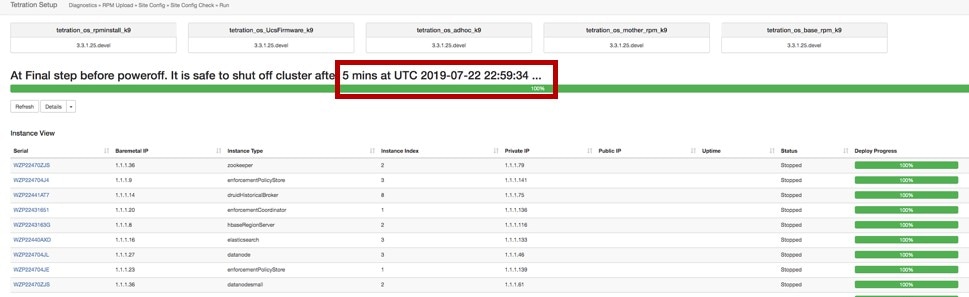

La page d’ état de la grappe, sous le menu dépannage dans la barre de navigation de gauche, est accessible aux administrateurs du site, mais les actions ne peuvent être effectuées que par les utilisateurs du service d'assistance à la clientèle. Il affiche l’état de tous les serveurs physiques du support Cisco Cisco Secure Workload. Chaque ligne du tableau représente un nœud physique avec des détails tels que la configuration de son matériel et de son micrologiciel et l'adresse IP de son contrôleur CIMC (si attribuée). Vous pouvez afficher la vue détaillée du nœud en cliquant sur la ligne . Dans cette page, nous pouvons également modifier le mot de passe CIMC des nœuds et activer ou désactiver l’accès externe. L’état de l’orchestrateur est également affiché sur la page d’état de la grappe pour fournir un contexte au service d'assistance à la clientèle.

Actions qui affectent tous les nœuds

La modification du mot de passe du contrôleur CIMC et l’activation ou la désactivation de l’accès du contrôleur CIMC externe peuvent être effectuées à l’aide des options CIMC/TOR guest password (Mot de passe invité CIMC/TOR) et Change external access (modifier l’accès externe). Les actions affectent tous les nœuds de la grappe.

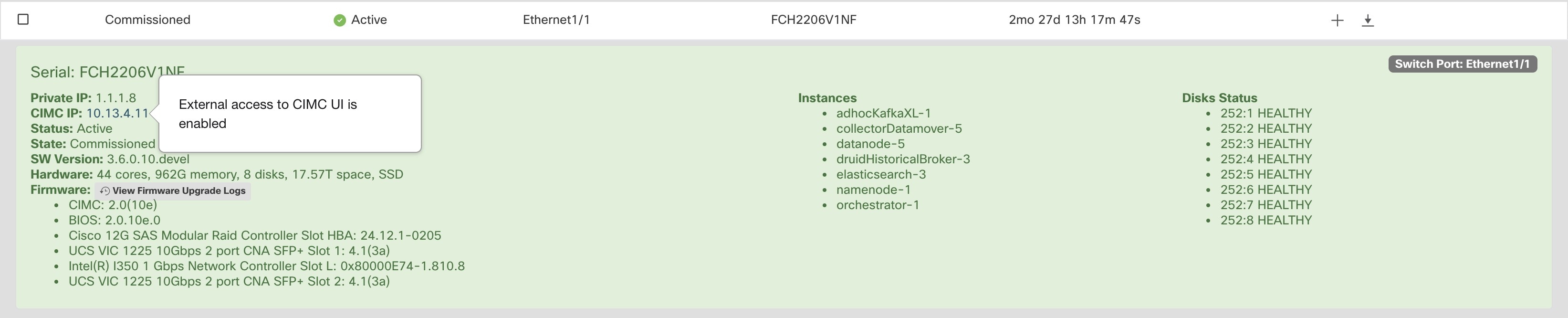

Détails du nœud d’accès du contrôleur CIMC externe

Cliquez sur Modifier l’accès externe pour ouvrir une boîte de dialogue qui fournit l’état de l’accès du contrôleur CIMC externe et permet d’activer, de renouveler ou de désactiver l’accès externe à CIMC.

Cliquez sur Enable (activer) pour configurer la grappe en arrière-plan pour activer l’accès CIMC externe. Cela peut prendre jusqu’à 60 secondes pour que les tâches soient terminées et que l’accès CIMC externe soit entièrement activé. Lorsque l’accès CIMC externe est activé, une boîte de dialogue s’affiche lorsque l’accès est défini pour expirer automatiquement et Enable (activer) passe à Renew (Renouveler) pour indiquer que vous pouvez renouveler l’accès CIMC externe. Le renouvellement de l’accès au contrôleur CIMC externe augmente l’heure d’expiration de deux heures par rapport à l’heure actuelle.

Si l’accès CIMC externe est activé, l’adresse IP du contrôleur CIMC dans les détails du nœud (visible en cliquant sur la ligne d'un nœud) devient un lien sur lequel vous pouvez accéder directement à l’interface utilisateur du contrôleur CIMC. Vous devrez peut-être recharger la page d’état de la grappe pour afficher les liens.

L’interface utilisateur du contrôleur CIMC comporte généralement un certificat autosigné. L’accès à l’interface utilisateur du contrôleur CIMC entraînera probablement une erreur dans le navigateur indiquant que le certificat n’est pas valide. Si vous utilisez Google Chrome, vous devrez peut-être taper thisisunsafe sans guillemets lorsque l’erreur de certificat non valide s’affiche pour contourner la vérification de certificat et accéder à l’interface utilisateur du contrôleur CIMC.

Dans l’interface utilisateur du contrôleur CIMC, l’accès KVM n’est fonctionnel que si la version du contrôleur CIMC est 4.1(1g) ou ultérieure. Une fois l’accès CIMC externe activé, il est automatiquement désactivé au bout de deux heures, sauf si l’accès est renouvelé ou désactivé.

La désactivation de l’accès CIMC externe configure la grappe en arrière-plan pour désactiver l’accès CIMC externe. Cela peut prendre jusqu’à 60 secondes pour que la tâche se termine et que l’accès CIMC externe soit complètement désactivé.

|

Champ |

Description |

|---|---|

|

État |

Le champ Status (État) indique l’état de l’alimentation du nœud. Les valeurs possibles sont les suivantes :

|

|

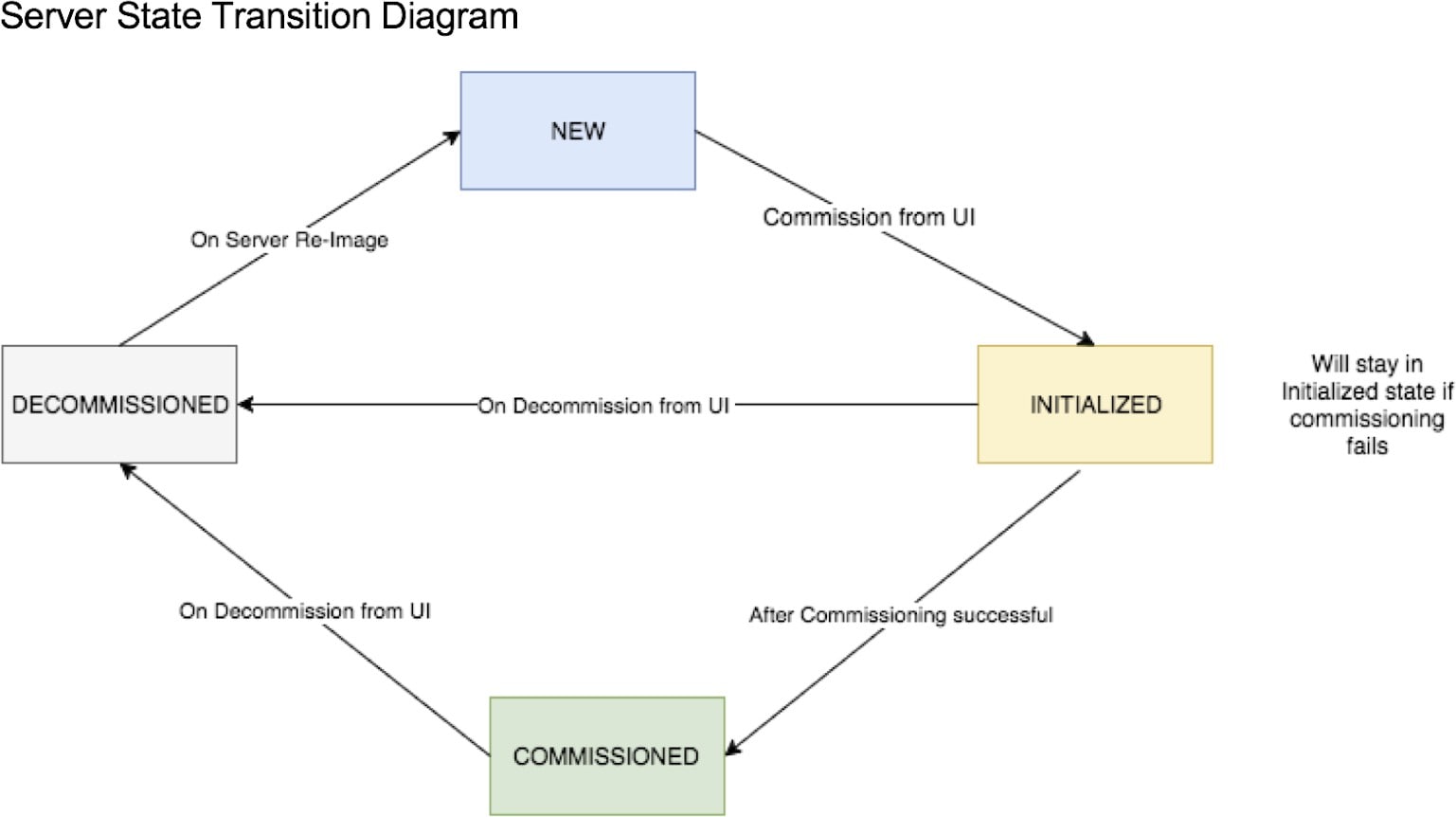

Province |

Le champ State (État) indique l’état d’appartenance à la grappe du nœud. Les valeurs possibles sont les suivantes :

|

|

Port de commutation |

Désigne le port de commutateur des deux commutateurs sur lesquels le nœud physique est connecté. |

|

Disponibilité |

Indique la durée pendant laquelle le nœud a fonctionné sans redémarrage ni arrêt. |

|

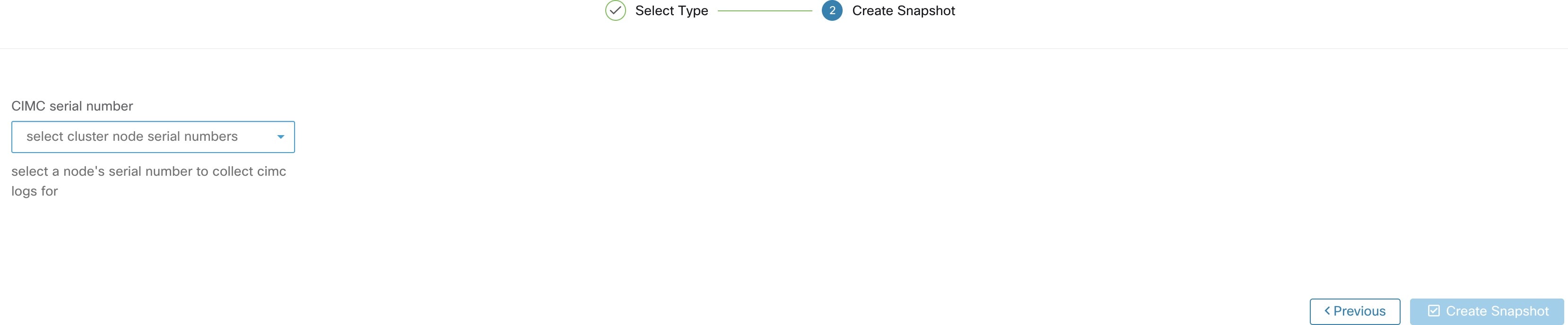

Instantanés du contrôleur CIMC |

Peuvent être utilisés pour lancer une collecte d’assistance technique du contrôleur CIMC et télécharger un fichier d’assistance technique du contrôleur CIMC. |

|

Action |

Description |

||

|---|---|---|---|

|

Mise en service |

Sélectionnez cette action pour intégrer de nouveaux nœuds dans la grappe. Seuls les nœuds avec l’état Nouveau peuvent être sélectionnés pour cette action. |

||

|

Mise hors service |

Sélectionnez cette action pour supprimer les nœuds qui font partie de la grappe. Seuls les nœuds avec l’état Mise en service ou Initialisé peuvent être sélectionnés pour cette action. |

||

|

Recréation d'image |

Sélectionner cette action pour redéployer Cisco Secure Workload. Cela peut effacer toutes les données de la grappe et est particulièrement utile pour la mise à niveau d'une machine sans système d’exploitation à partir d’une version antérieure vers une nouvelle. Cette étape est requise lors de la désactivation d’une machine sans système d’exploitation. |

||

|

Mise à niveau du micrologiciel |

Les informations sur le micrologiciel sont disponibles pour les nœuds pour lesquels l’adresse IP du contrôleur CIMC est accessible. Cette action est utile pour mettre à niveau le micrologiciel sur les nœuds avec des versions plus anciennes. |

||

|

Mettre hors tension |

Sélectionnez cette action pour mettre les nœuds hors tension.

|

La grappe Cisco Secure Workload sur site regroupe un système informatique unifié (UCS) Cisco Integrated Management Controller (CIMC) Host Upgrade Utility (HUU) ISO. L’option de mise à niveau du micrologiciel sur la page d’état de la grappe peut être utilisée pour mettre à jour une version physique sans système d’exploitation vers la version du micrologiciel UCS incluse dans l’image HUU ISO qui a été groupée dans les RPM Cisco Secure Workload.

La mise à jour du micrologiciel peut commencer sur un hôte sans système d’exploitation lorsque l’état est actif ou inactif , tant que l’état sans système d’exploitation n’est pas initialisé ou Incompatibilité UGS. Un seul micrologiciel UCS à la fois peut voir son micrologiciel UCS mis à jour. Pour démarrer la mise à jour du micrologiciel, l’état Cisco Secure Workload de l’orchestrateur doit être Idle (inactif). Lorsque la mise à jour du micrologiciel UCS est lancée, certaines des fonctionnalités de l’interface utilisateur spécifiques à la page d’état de la grappe peuvent être temporairement touchées si le consul leader, l’orchestration ou le gestionnaire actif du micrologiciel (fwmgr) doit être commuté vers d’autres hôtes - ces basculements devraient se produire automatiquement . Pendant la mise à jour du micrologiciel, les détails du micrologiciel du système sans système d’exploitation mis à jour ne s’afficheront pas. Après la mise à jour, cela peut prendre jusqu’à 15 minutes avant que les détails du micrologiciel ne s’affichent à nouveau dans la page Cluster Status (État de la grappe). Avant de commencer la mise à jour du micrologiciel, consultez la page Service Status (État des services) pour vérifier que tous les services sont intègres.

Lorsque vous lancez une mise à jour de micrologiciel sur un système sans système d’exploitation, fwmgr vérifie que la mise à jour peut se poursuivre, met hors tension normalement le système sans système d’exploitation si nécessaire, puis se connecte au contrôleur CIMC sur l’environnement sans système d’exploitation et démarre la mise à jour du micrologiciel basée sur HUU. Ce processus de mise à jour du micrologiciel basé sur HUU implique de démarrer le matériel sans système d’exploitation dans HUU ISO, d’effectuer la mise à jour, de redémarrer le contrôleur CIMC pour activer le nouveau micrologiciel, puis de redémarrer la machine sans système d’exploitation dans HUU ISO pour vérifier que la mise à jour a été effectuée. Le processus global de mise à jour peut prendre plus de 2 heures pour un G1 sans système d’exploitation ou plus d’une heure pour un G2 sans système d’exploitation. Lorsque le processus de mise à jour du micrologiciel est lancé, la page Service Status (État du service) peut indiquer que certains services ne sont pas intègres, car les systèmes sans système d'exploitation et toutes les machines virtuelles fonctionnant sur ces services sans système d'exploitation ne sont plus actifs dans la grappe. Lorsque la mise à jour du micrologiciel est terminée, cela peut prendre 30 minutes de plus pour que le système sans système d’exploitation redevienne actif dans la grappe, et il faudra peut-être plus de temps pour que tous les services soient de nouveau intègres. Si les services ne récupèrent pas dans les deux heures suivant une mise à jour du micrologiciel, contactez un représentant du service d'assistance à la clientèle.

Vous pouvez cliquer sur un nœud sans système d’exploitation dans la page Cluster Status (État de la grappe ) pour développer les détails de ce nœud. Lorsqu'une mise à jour du micrologiciel est lancée, vous pouvez cliquer sur le bouton View Firmware Upgrade Logs (Afficher les journaux de mise à niveau du micrologiciel) pour afficher l'état de la mise à jour du micrologiciel. Le journal contient l’état général de la mise à jour du micrologiciel. L’état peut être :

La mise à jour du micrologiciel a été déclenchée : la mise à jour du micrologiciel a été demandée, mais n’a pas encore commencé. Pendant cet état, fwmgr vérifiera que les services requis pour la mise à jour du micrologiciel sont fonctionnels et que le CIMC peut accéder à ces services.

La mise à jour du micrologiciel est en cours d’exécution : la mise à jour du micrologiciel a été lancée. Lorsqu’une mise à jour de micrologiciel atteint cet état, le contrôleur CIMC et HUU contrôlent la mise à jour, et la grappe Cisco Secure Workload signale l’état que lui fournit CIMC au sujet de la mise à jour.

La mise à jour du micrologiciel a expiré : cela indique qu’un processus de mise à jour du micrologiciel a dépassé le délai attendu. Le processus global de mise à jour du micrologiciel a une limite de 240 minutes lorsqu’il entre dans la phase de mise à jour du micrologiciel en cours . Pendant la mise à jour du micrologiciel, CIMC peut devenir inaccessible lors du redémarrage avec la nouvelle version, cet état inaccessible a un délai de 40 minutes avant que la mise à jour du micrologiciel ne soit déclarée expirée. Lorsque la mise à jour du micrologiciel a commencé, la surveillance de cette mise à jour expire après 120 minutes.

La mise à jour du micrologiciel a échoué avec une erreur : ceci indique qu’une erreur est survenue et que la mise à jour du micrologiciel a échoué. Le contrôleur CIMC ne donne généralement pas d’indication de réussite ou d’échec, donc cet état indique généralement qu’une erreur s’est produite avant que la mise à jour du micrologiciel ne soit en cours d’exécution.

Fin de la mise à jour du micrologiciel : la mise à jour du micrologiciel s’est terminée sans erreur ni délai d’expiration. Le contrôleur CIMC ne donne généralement pas d’indication de réussite ou d’échec, il est préférable de vérifier que les versions du micrologiciel UCS sont mises à jour lorsque ces détails deviennent disponibles dans la page Cluster Status (État de la grappe) - cela peut prendre jusqu’à 15 minutes pour que ces détails soient disponibles.

Sous l’état général dans la fenêtre contextuelle View Firmware Upgrade Logs (afficher les journaux de mise à niveau du micrologiciel) se trouve une section de progression de la mise à jour qui contiendra des messages de journal horodatés indiquant la progression de la mise à jour du micrologiciel. Lorsque l’état de redémarrage de l’hôte en cours est affiché dans ces messages de journal, CIMC contrôle la mise à jour et la grappe la surveille. La plupart des messages de journal suivants proviennent directement du CIMC et ne sont ajoutés à la liste des messages de journal que si l'état de la mise à jour change.

Sous la section de progression de la mise à jour de la fenêtre contextuelle View Firmware Upgrade Logs (Afficher les journaux de mise à jour du micrologiciel), une section Component update status (État de mise à jour des composants) s’affichera lorsque CIMC commencera à fournir des états de mise à jour de composant individuel. Cette section résume l’état de la mise à jour des divers composants UCS sur le système sans système d’exploitation.

La sauvegarde et la restauration des données sont un mécanisme de reprise après sinistre qui copie les données de la grappe Cisco Secure Workload, des connecteurs et des orchestrateurs externes vers un stockage hors site. En cas de sinistre, les données sont restaurées à partir du stockage hors site vers une grappe de même type de taille. Vous pouvez également basculer entre différents sites de sauvegarde.

La sauvegarde et la restauration des données sont prises en charge pour les grappes physiques de 8 et 39 RU.

Les données peuvent être sauvegardées dans n’importe quel stockage d’objets externe compatible avec l’API S3V4.

Cisco Secure Workload nécessite une bande passante et un stockage suffisants pour sauvegarder les données. Des vitesses de réseau lentes et une latence élevée peuvent faire échouer les sauvegardes.

Les limites de stockage des données sont basées sur le type de sauvegarde sélectionné.

Pour la sauvegarde de données en mode continu, nous vous recommandons de stocker 200 To pour les sauvegardes complètes, y compris les données de flux. Pour déterminer l’espace de stockage réel requis, utilisez l’option du planificateur de capacité disponible sur la page de sauvegarde des données. Pour en savoir plus, consultez Utiliser le Planificateur de capacité. Le manque d'espace de stockage pour de multiples sauvegardes entraîne la suppression fréquente d'anciennes sauvegardes afin de pouvoir gérer les sauvegardes dans la limite de l'espace de stockage. Il doit y avoir suffisamment de stockage pour au moins une sauvegarde.

Pour la sauvegarde des données en mode continu, le stockage minimal requis est de 50 To pour les sauvegardes complètes, y compris les données de flux. Pour déterminer l’espace de stockage réel requis, utilisez l’option du planificateur de capacité disponible sur la page de sauvegarde des données. Pour en savoir plus, consultez Utiliser le Planificateur de capacité. Le manque d'espace de stockage pour de multiples sauvegardes entraîne la suppression fréquente d'anciennes sauvegardes afin de pouvoir gérer les sauvegardes dans la limite de l'espace de stockage. Il doit y avoir suffisamment de stockage pour au moins une sauvegarde.

Pour les sauvegardes en mode allégé, 1 To de stockage est suffisant, car les données de flux, qui constituent la majeure partie des données de sauvegarde, ne sont pas incluses dans la sauvegarde.

Les données peuvent uniquement être restaurées dans une grappe de taille compatible, exécutant la même version que la grappe principale. Par exemple, vous pouvez restaurer les données d’une grappe de 8 RU uniquement vers une autre de 8 RU.

Un calendrier pour la sauvegarde des données peut être configuré à l’aide de la section Sauvegarde des données de l’interface utilisateur. Les sauvegardes sont déclenchées une fois par jour et à l’heure programmée en fonction des paramètres configurés ou peuvent être configurées pour s’exécuter en continu. Une sauvegarde réussie s’appelle un point de contrôle. Un point de contrôle est un instantané à un point dans le temps des magasins de données principaux de la grappe.

Un point de contrôle réussi peut être utilisé pour restaurer les données sur une autre grappe ou au sein de la même grappe.

Les données de configuration de la grappe sont toujours sauvegardées pour chaque point de contrôle. Le flux et d’autres données constituent la majeure partie des données sauvegardées. Par conséquent, si elles sont configurées correctement, seules les modifications incrémentielles sont sauvegardées. Les sauvegardes incrémentielles permettent de réduire la quantité de données transférées vers le stockage externe, ce qui évite de surcharger le réseau. Si vous le souhaitez, une sauvegarde complète peut être déclenchée selon une planification convenue pour toutes les sources de données lorsque la sauvegarde incrémentielle est configurée. Une sauvegarde complète copie chaque objet d’un point de contrôle, même s’il est déjà copié et que l’objet n’a pas été modifié. Cela peut ajouter une charge importante sur la grappe, sur le réseau entre la grappe et la bibliothèque d’objets, et sur la bibliothèque d’objets elle-même. Une sauvegarde complète peut s'avérer nécessaire en cas de détérioration des objets ou de défaillance matérielle irrémédiable de la bibliothèque d'objets. En outre, si le compartiment fourni pour la sauvegarde change, une sauvegarde complète est automatiquement appliquée, car une sauvegarde complète est nécessaire pour que les sauvegardes incrémentielles soient utiles.

|

Données de grappe Cisco Secure Workload |

Les données sont-elles sauvegardées en mode de sauvegarde complète? |

Les données sont-elles sauvegardées en mode allégé? |

|---|---|---|

|

Configurations de grappe |

Oui |

Oui |

|

RPM utilisés pour la création d’image de la grappe |

Oui |

Oui |

|

Images de déploiement d’agents logiciels |

Oui |

Oui |

|

Base de données de flux |

Oui |

Non |

|

Données requises pour la découverte automatique des politiques |

Oui |

Non |

|

Données pour faciliter la criminalistique, comme les condensés de fichiers et les modèles de fuites de données. |

Oui |

Non |

|

Données pour faciliter l’analyse de la surface d’attaque |

Oui |

Non |

|

Bases de données CVE. |

Oui |

Non |

Note |

|

Communiquez avec le Centre d’assistance technique de Cisco pour activer les options de sauvegarde et de restauration des données sur votre grappe.

Les clés d’accès et secrètes du magasin d’objets sont requises. L’option de sauvegarde et de restauration des données ne fonctionne pas avec le lien pré-authentifié pour le magasin d'objets.

Les enregistrements DNS A et AAAA doivent être mis à jour avec le nom de domaine complet du serveur S3. Si la grappe est configurée pour utiliser une adresse IPv6 pour accéder à l’URL S3, mettez uniquement à jour l’enregistrement DNS AAAA avec le nom de domaine complet du serveur S3.

Configurez un contrôle éventuel pour limiter la bande passante utilisée par le appareil Cisco Secure Workload vers un magasin d'objets. Un contrôle avec une faible bande passante lorsque le volume de données à sauvegarder est élevé peut entraîner des échecs de sauvegarde.

Configurez les noms de domaine complets de la grappe et assurez-vous que les agents logiciels peuvent résoudre ces derniers.

Note |

Après avoir activé la sauvegarde et la restauration des données, seules les versions actuelle et ultérieures de l’agent logiciel sont disponibles pour l’installation et la mise à niveau. Les versions antérieures à la version de grappe actuelle restent masquées en raison d’une incompatibilité. |

Exigences relatives à l’agent logiciel ou au nom de domaine complet Kafka

Les agents logiciels utilisent des adresses IP pour obtenir des informations de contrôle du dispositif Cisco Secure Workload. Pour activer la sauvegarde et la restauration des données et permettre un basculement transparent après un sinistre, les agents doivent passer à l’utilisation du nom de domaine complet. La mise à niveau de la grappe Cisco Secure Workload n’est pas suffisante pour ce commutateur. Les agents logiciels prennent en charge l’utilisation du nom de domaine complet à partir de la version 3.3 et des versions ultérieures de Cisco Secure Workload. Par conséquent, pour activer le basculement des agents et vous assurer que les agents sont prêts pour la sauvegarde et la restauration des données, mettez les agents à niveau vers la version 3.3 ou une version ultérieure.

Si les noms de domaine complets ne sont pas configurés, les noms de domaine complets par défaut sont :

|

Type d’IP |

Nom de domaine complet (FQDN) par défaut |

|---|---|

|

VIP de capteur |

wss{{cluster_ui_fqdn}} |

|

Kafka 1 |

kafka-1-{{cluster_ui_fqdn}} |

|

Kafka 2 |

kafka-2-{{cluster_ui_fqdn}} |

|

Kafka 3 |

kafka-3-{{cluster_ui_fqdn}} |

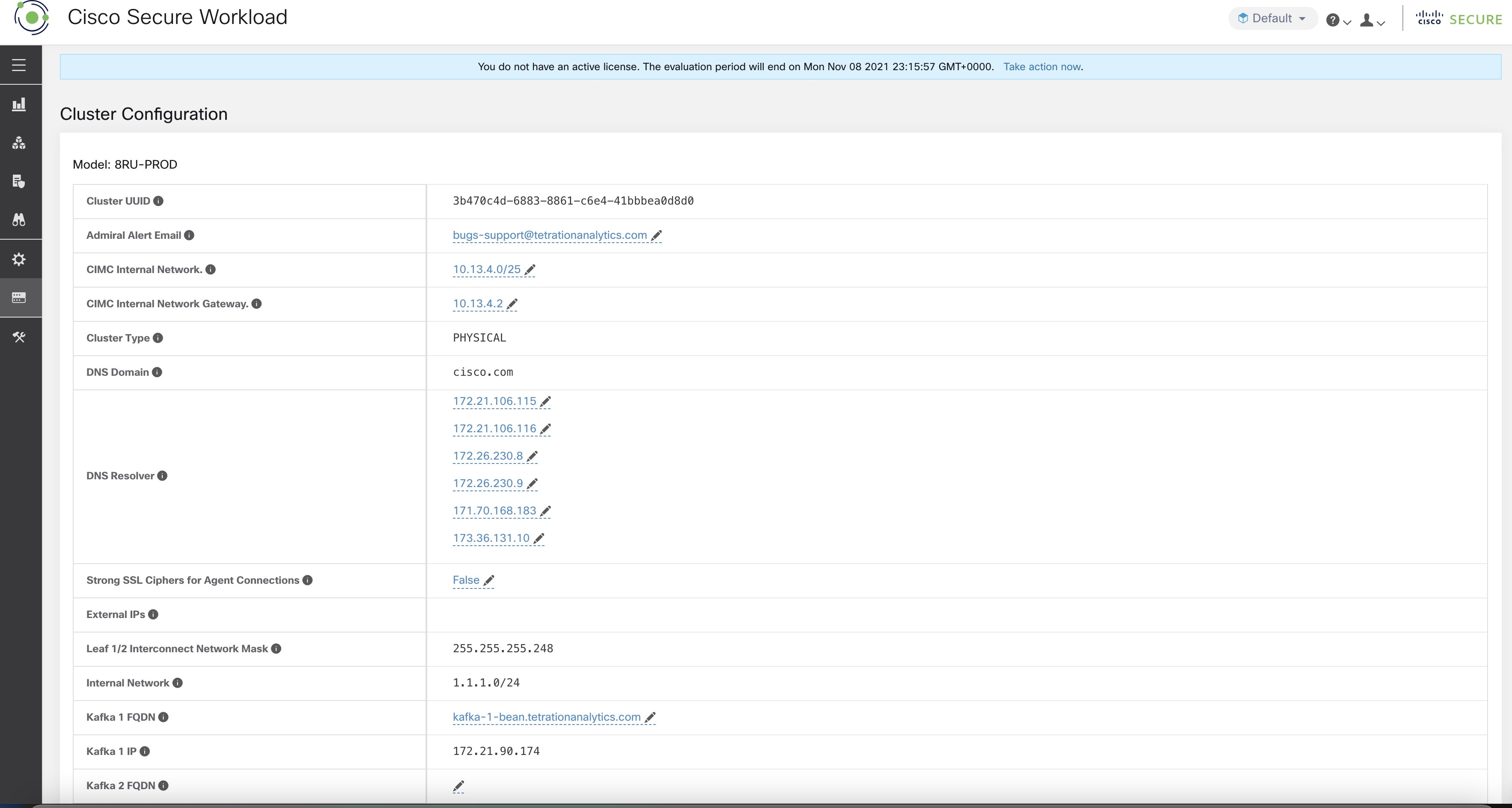

Les noms de domaine complets peuvent être modifiés sur la page .

Mettez à jour l’enregistrement DNS pour les noms de domaine complets avec les adresses IP fournies sur la même page. Le tableau suivant répertorie le mappage des adresses IP et des noms de domaine complets.

|

Nom du champ |

Champ IP correspondant |

Description |

|---|---|---|

|

Nom de domaine complet (FQDN) de la VIP de capteur |

VIP de capteur |

Mettre à jour le nom de domaine complet pour la connexion au plan de contrôle de la grappe |

|

Nom de domaine complet (FQDN) Kafka 1 |

Kafka 1 IP |

IP du nœud Kafka 1 |

|

Nom de domaine complet (FQDN) Kafka 2 |

Kafka 2 IP |

IP du nœud Kafka 2 |

|

Nom de domaine complet (FQDN) Kafka 3 |

Kafka 3 IP |

IP du nœud Kafka |

Note |

Le nom de domaine complet pour les VIP et hôtes Kafka de capteurs ne peut être modifié qu’avant la configuration de la sauvegarde et de la restauration des données. Après la configuration, le nom de domaine complet (FQDN) ne peut pas être modifié. |

Le magasin d’objets doit fournir une interface de plainte S3V4.

Note |

Quelques stockages d’objets conformes à S3V4 ne prennent pas en charge la fonctionnalité DeleteObjects (SupprimerObjets). La fonctionnalité DeleteObjects est requise pour supprimer les informations de point de contrôle obsolètes. L’absence de cette fonctionnalité peut entraîner des échecs lors de la tentative de suppression des points de contrôle obsolètes du stockage et peut entraîner un manque d’espace du stockage. |

Site

L'emplacement du magasin d'objets est essentiel pour la latence liée à la sauvegarde et à la restauration du magasin. Pour améliorer le temps de restauration, vérifiez que le magasin d'objets est situé plus près de la grappe de secours.

Compartiment

Créez un nouveau compartiment dédié à Cisco Secure Workload dans le magasin d’objets. Seule la grappe doit avoir un accès en écriture à ce compartiment. La grappe écrira les objets et gérera la rétention sur le compartiment. Mettez en service au moins 200 To de stockage pour le compartiment et obtenez un accès et une clé secrète pour ce dernier. La sauvegarde et la restauration des données dans Cisco Secure Workload ne fonctionnent pas avec les liens pré-authentifiés.

Note |

Si vous utilisez Cohesity comme magasin d’objets, désactivez les chargements en plusieurs parties lors de la planification. |

HTTPS

L’option de sauvegarde de données prend uniquement en charge l’interface HTTPS avec le magasin d’objets. Cela permet de s’assurer que les données en transit vers ce dernier sont chiffrées et sécurisées. Si le certificat de stockage SSL/TSL est signé par une autorité de certification tierce de confiance, la grappe l’utilisera pour authentifier le magasin d’objets. Si le magasin d’objets utilise un certificat autosigné, la clé publique ou l’autorité de certification peut être téléversée en sélectionnant l’option Use Server CA Certificate (Utiliser le certificat de l’autorité de certification du serveur).

Chiffrement côté serveur

Il est fortement recommandé d’activer le chiffrement côté serveur pour le compartiment affecté à la grappe de Cisco Secure Workload. La grappe utilisera HTTPS pour transférer les données vers le magasin d’objets. Cependant, le magasin d’objets doit chiffrer les objets pour s’assurer que les données stockées sont sécurisées.

Note |

|

Pour configurer la sauvegarde des données dans Cisco Secure Workload, procédez comme suit :

Planification : L’option de sauvegarde des données fournit un planificateur pour tester l’accès à la bibliothèque d’objets, déterminer les besoins de stockage et la durée de la sauvegarde nécessaire pour chaque jour. Cette fonction peut être utilisée pour expérimenter avant de configurer un calendrier.

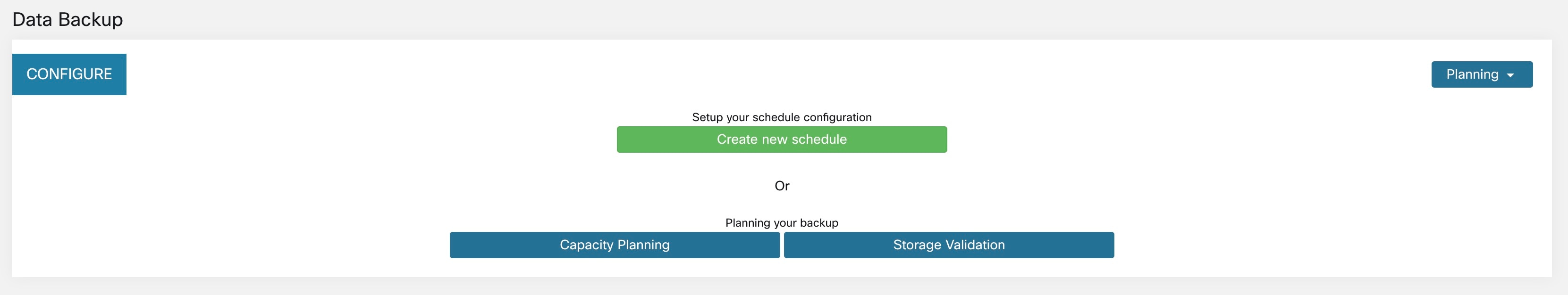

Pour utiliser les calculateurs de sauvegarde et de restauration de données, accédez à Si la sauvegarde et la restauration des données ne sont pas configurées, vous accéderez à la page de destination de la sauvegarde des données.

Note |

Si vous ne parvenez pas à afficher l’option de sauvegarde des données sous la plateforme, assurez-vous de disposer de la licence pour activer la sauvegarde et la restauration des données. |

Configuration et planification de la sauvegarde des données : Cisco Secure Workload copiera les données dans la bibliothèque d’objets uniquement durant la fenêtre temporelle configurée. Lors de la configuration de la sauvegarde pour la première fois, les vérifications préalables seront exécutées pour s’assurer que les noms de domaine complets (FQDN) peuvent être résolus et qu’ils sont résolus à la bonne adresse IP. Après la validation initiale, une mise à jour est envoyée aux agents logiciels enregistrés qui utilisent les noms de domaine complets (FQDN). Sans nom de domaine complet, les agents ne peuvent pas basculer vers une autre grappe après un sinistre. Pour ce faire, les agents doivent être mis à niveau vers la dernière version prise en charge par la grappe et tous les agents doivent être en mesure de résoudre le nom de domaine complet de la VIP du capteur. À partir de la version 3.3 de Cisco Secure Workload, seuls les agents de visibilité approfondie et d’application prennent en charge la sauvegarde et la restauration de données et passeront à l’utilisation du nom de domaine complet.

Pour créer un calendrier et configurer la sauvegarde des données, consultez Configurer la sauvegarde des données.

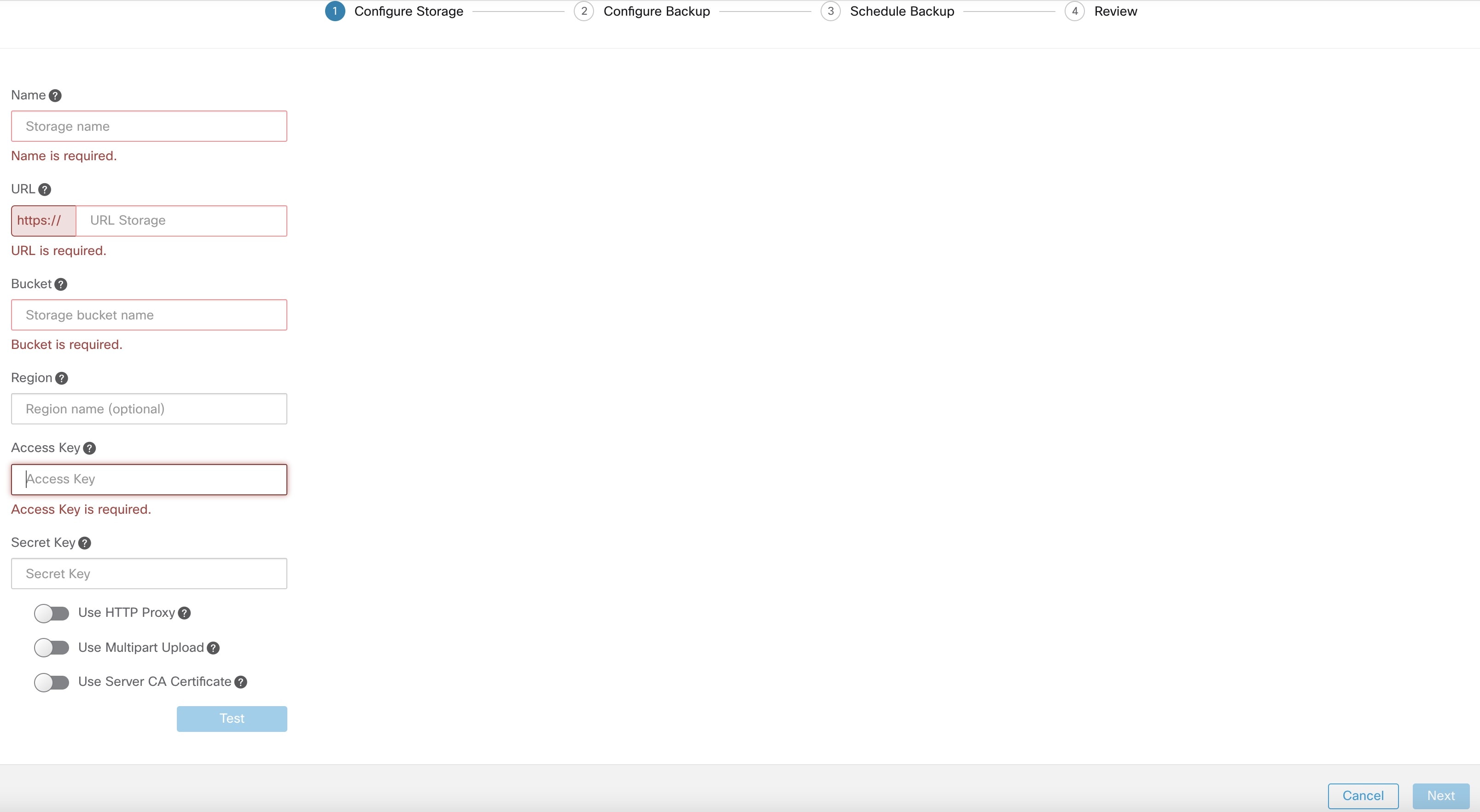

|

Step 1 |

Pour vous assurer que le stockage est compatible avec Cisco Secure Workload, effectuez l’une des actions suivantes :

|

||

|

Step 2 |

Saisissez les informations suivantes :

|

||

|

Step 3 |

(Facultatif) Si nécessaire, vous pouvez activer le serveur mandataire HTTP. |

||

|

Step 4 |

(Facultatif) Pour utiliser des chargements en plusieurs parties des données sauvegardées, activez Use Multipart Upload(utiliser le chargement en plusieurs parties) . |

||

|

Step 5 |

(Facultatif) Si un certificat de l’autorité de certification est requis pour authentifier le serveur de stockage, activez l’option Use Server CA Certificate (utiliser le certificat de l’autorité de certification du serveur) et saisissez les détails du certificat. |

||

|

Step 6 |

Cliquez sur Test. |

La validation du stockage permet de tester :

L'authentification et l'accès au magasin d'objets et au compartiment.

Le téléchargement vers et depuis le compartiment configuré.

Les vérifications de la bande passante.

Le processus de planification du stockage peut prendre environ cinq minutes.

|

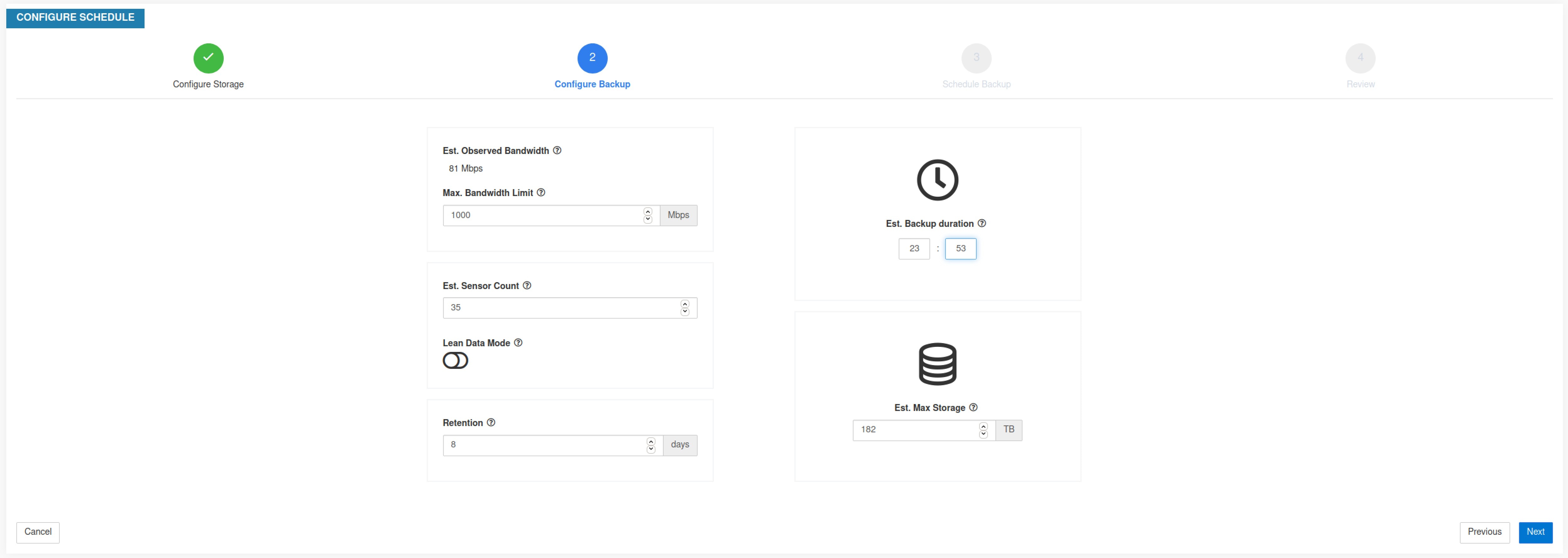

Step 1 |

Pour planifier la taille de stockage et les estimations de la fenêtre de sauvegarde, effectuez l’une des actions suivantes :

|

|

Step 2 |

Saisissez la limite de bande passante maximale pour sauvegarder les données. Cette bande passante doit au plus correspondre à la configuration du contrôleur qui limitera les données envoyées au magasin d’objets. |

|

Step 3 |

Le nombre d’agents logiciels enregistrés est rempli automatiquement. En fonction des prévisions, vous pouvez modifier le nombre d’agents. |

|

Step 4 |

(Facultatif) Activez Lean Data Mode (le mode de données allégé) pour exclure les données qui ne font pas partie de la configuration de la sauvegarde. L'utilisation de cette option réduit la limite de stockage de 75 %. |

|

Step 5 |

Le stockage maximal configuré pour l’ensemble de stockage. Cela définira automatiquement la période de rétention des sauvegardes. |

Une fois les renseignements détaillés requis saisis, la durée estimée de la sauvegarde affiche le temps requis pour la sauvegarde des données d’une journée. Il s’agit d’une estimation basée sur la charge d’agent typique, le nombre d’agents estimatif et la bande passante maximale configurée. L’estimation de la capacité de stockage maximale affiche l’estimation de la capacité de stockage maximale requise par Cisco Secure Workload pour prendre en charge la rétention précisée et le nombre estimatif d’agents.

|

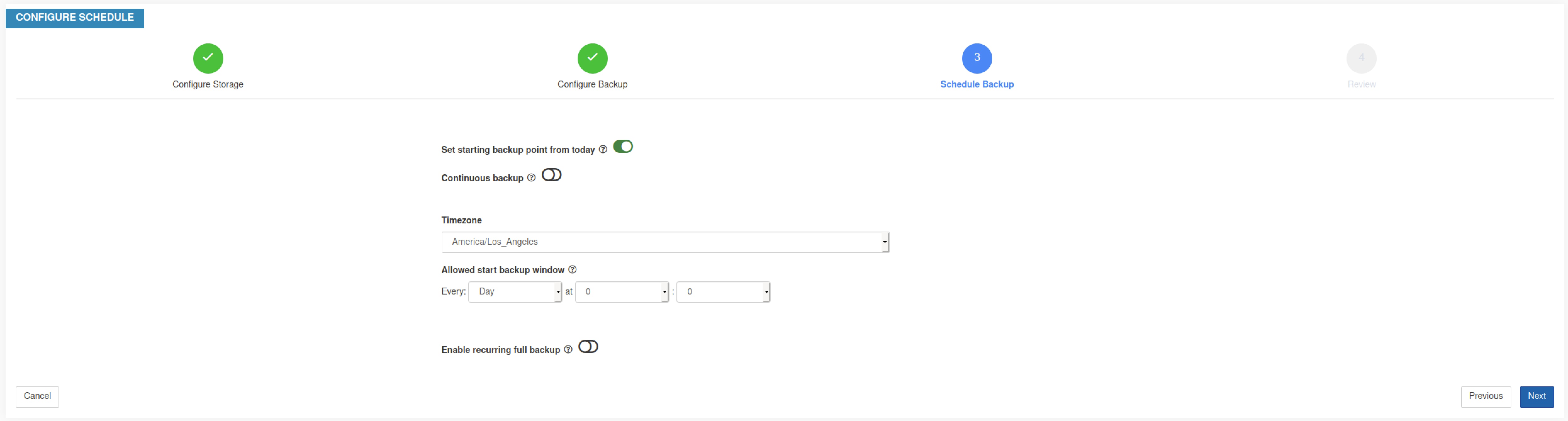

Step 1 |

Dans la page de destination de la sauvegarde des données, cliquez sur Create new schedule (Créer une nouvelle planification). |

||

|

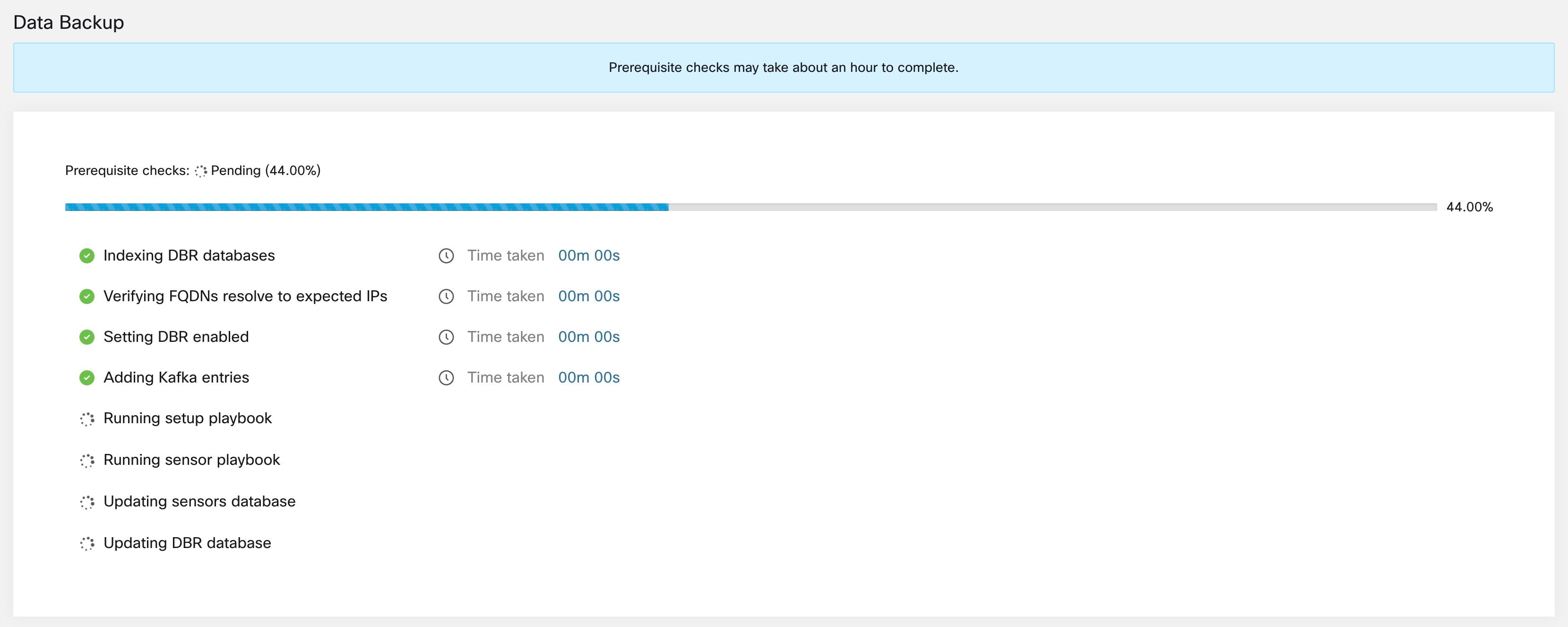

Step 2 |

Pour confirmer les vérifications des préalables à exécuter, cochez les boutons Approve (approuver) et cliquez sur Proceed (Continuer). La vérification des préalables prend environ 30 minutes et n'est exécutée que lors de la première configuration d’une planification.

|

||

|

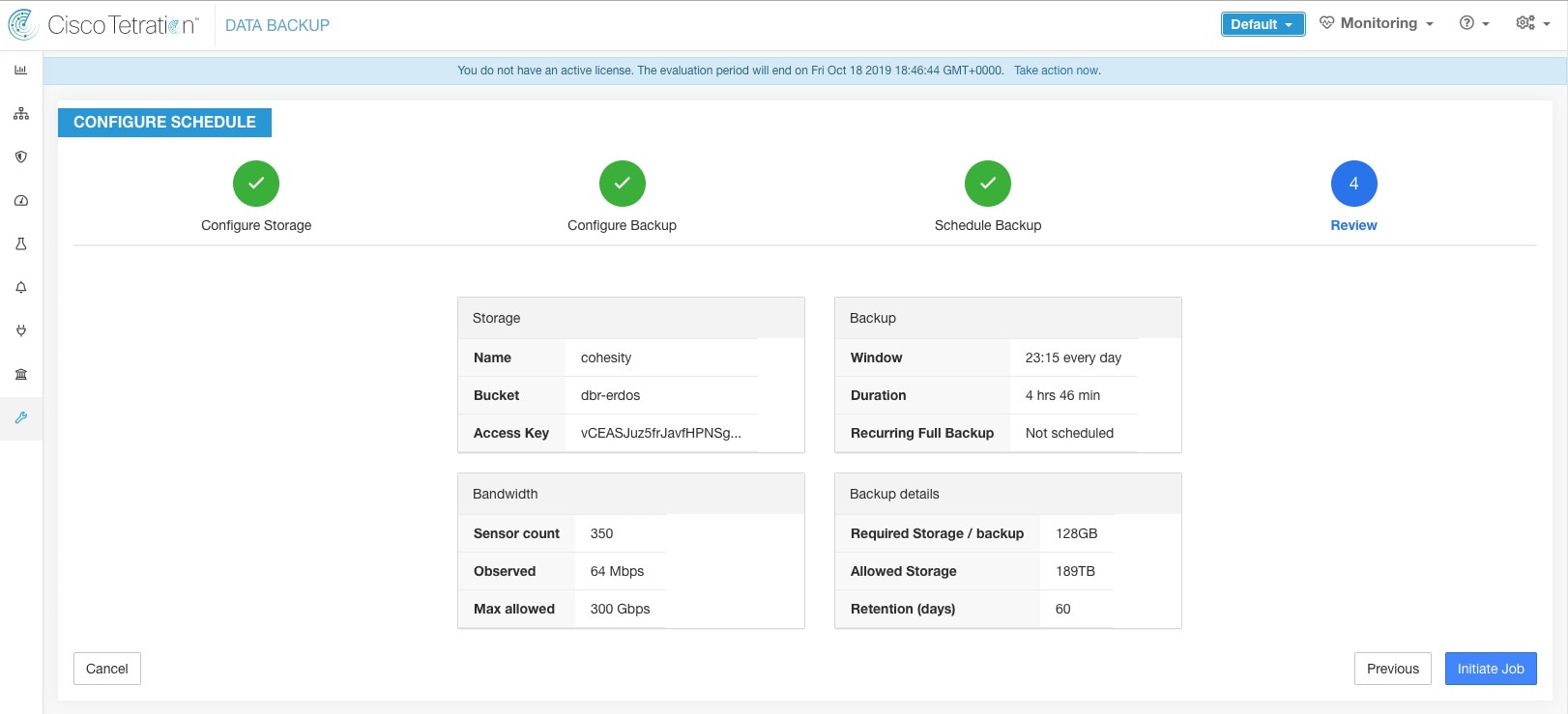

Step 3 |

Pour configurer le stockage, entrez les détails suivants et cliquez sur Test (Tester).

|

||

|

Step 4 |

Pour configurer la capacité de stockage, saisissez les informations suivantes :

|

||

|

Step 5 |

Pour planifier la sauvegarde, activez les éléments suivants :

|

||

|

Step 6 |

Passez en revue la planification et les paramètres de sauvegarde configurés, puis cliquez sur Initiate Job (Démarrer a tâche).

|

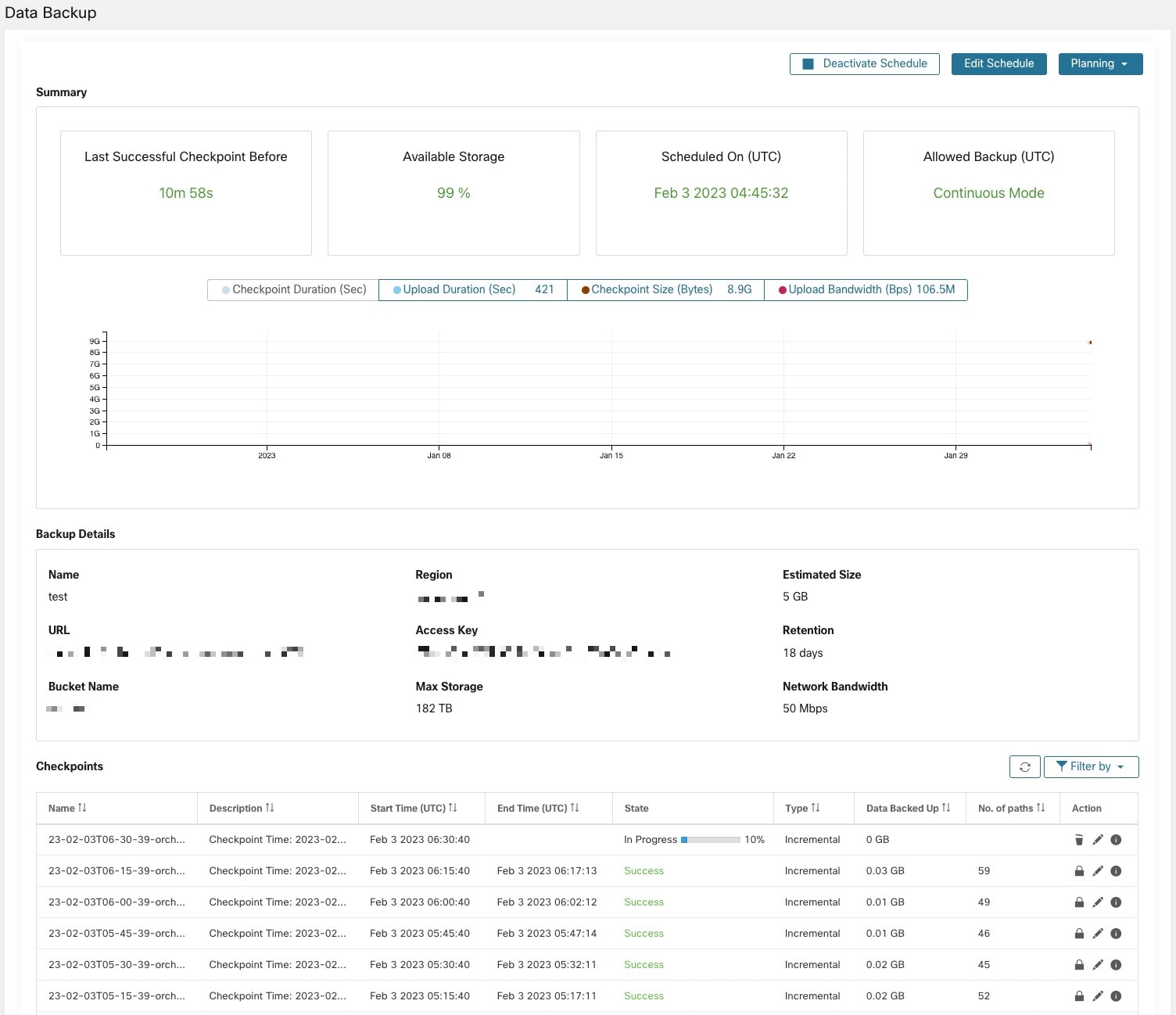

Après la configuration de la sauvegarde des données, elle est déclenchée tous les jours à une heure planifiée, sauf si le mode continu est activé. L'état des sauvegardes peut être consulté sur le tableau de bord de la sauvegarde des données en accédant à .

Le temps écoulé depuis le dernier point de contrôle réussi doit être inférieur à 24 heures + le temps nécessaire au point de contrôle. Par exemple, si le point de contrôle + la sauvegarde prennent environ 6 heures, le temps écoulé depuis le dernier point de contrôle réussi doit être inférieur à 30 heures.

Les graphiques suivants fournissent des renseignements supplémentaires :

Durée du point de contrôle : ce graphique montre la ligne de tendance de la durée du point de contrôle.

Durée du chargement : ce graphique montre la ligne de tendance pour le temps nécessaire au chargement du point de contrôle vers la base de données de sauvegarde.

Taille du point de contrôle : ce graphique montre la ligne de tendance pour la taille du point de contrôle.

Bande passante de téléversement : ce graphique montre la ligne de tendance de la bande passante de téléversement.

Le tableau présente tous les points de contrôle. Les étiquettes de point de contrôle peuvent être modifiées et seront disponibles lors du choix d’un point de contrôle pour restaurer les données sur la grappe de secours.

Un point de contrôle passe par plusieurs états. Voici les états possibles :

Créé/en attente : le point de contrôle vient d’être créé et en attente de copie.

En cours d’exécution : les données sont sauvegardées activement sur un stockage externe

Réussite : le point de contrôle est terminé et a réussi; peut être utilisé pour la restauration des données

Échec : le point de contrôle est terminé et a échoué; ne peut pas être utilisé pour la restauration des données

Suppression en cours/Supprimé : un point de contrôle obsolète est en cours de suppression ou est supprimé

Pour modifier la planification ou le regroupement, cliquez sur Edit Schedule (Modifier le calendrier). Pour terminer la mise en œuvre de l’assistant, consultez la section Configurer la sauvegarde des données.

Pour résoudre les erreurs lors de la création des points de contrôle, consultez Dépannage : sauvegarde et restauration des données.

Les sauvegardes peuvent être désactivées en cliquant sur le bouton Deactivate Schedule (Désactiver la planification). Il est recommandé de désactiver la planification de sauvegarde avant d’y apporter des modifications. Désactivez la planification uniquement lorsqu’aucun point de contrôle n’est en cours. L’exécution d’un test ou la désactivation de la planification alors qu’un point de contrôle est en cours peut entraîner l’échec de ce dernier et un état indéfini du téléchargement.

La grappe Cisco Secure Workload gère le cycle de vie des objets du compartiment. Vous ne devez pas supprimer ni ajouter d’objets au compartiment. Cela pourrait entraîner des incohérences et endommager les points de contrôle réussis. Dans l’assistant de configuration, la mémoire maximale à utiliser doit être spécifiée. Cisco Secure Workload fait en sorte que l’utilisation du compartiment ne dépasse pas la limite configurée. Il existe un service de conservation du stockage qui élimine les objets après un certain temps et les supprime du compartiment. Une fois que l’utilisation du stockage a atteint un seuil (80 % de la capacité du compartiment) calculé en fonction du stockage maximal configuré et du débit de données entrantes, la fonction de rétention tente de supprimer les points de contrôle non conservés pour ramener l’utilisation sous le seuil. La fonction de rétention conservera également un minimum de deux points de contrôle réussis à tout moment et tous les points de contrôle préservés, le nombre le plus élevé des deux situations étant retenu. Si la fonction de rétention ne peut supprimer aucun point de contrôle pour libérer de l'espace, les points de contrôle commenceront à générer des échecs.

À mesure que de nouveaux points de contrôle sont créés, les anciens expirent et sont supprimés. Cependant, les points de contrôle peuvent être conservés, empêchant ainsi leur suppression par la fonction de rétention. Un point de contrôle conservé ne sera pas supprimé. S'il y a plusieurs points de contrôle conservés, à un moment donné, le stockage sera insuffisant pour les nouveaux objets et les points de contrôle périmés ne pourront pas être supprimés parce qu'ils ont été conservés. Une bonne pratique consiste à conserver les points de contrôle en fonction des besoins et à mettre à jour l'étiquette du point de contrôle en indiquant la raison et la validité comme référence. Pour conserver un point de contrôle, cliquez sur l’icône représentant un verrou à côté du point de contrôle requis.

Pour restaurer à l’aide de données sauvegardées, une grappe doit être en mode d’attente DBR. Actuellement, vous pouvez définir une grappe en mode veille uniquement lors de la configuration initiale.

Une fois que la grappe est en mode veille, choisissez Platform (plateforme) dans le volet de navigation pour accéder à l’option de restauration des données.

Cisco Secure Workload prend en charge les combinaisons suivantes :

|

UGS de grappe principale |

UGS de grappe en attente |

|---|---|

|

8RU-PROD |

8RU-PROD, 8RU-M5, 8RU-M6 |

|

8RU-M5 |

8RU-PROD, 8RU-M5, 8RU-M6 |

|

39RU-GEN1 |

39RU-GEN1, 39RU-M5, 39RU-M6 |

|

39RU-M5 |

39RU-GEN1, 39RU-M5, 39RU-M6 |

|

8RU-M6 |

8RU-PROD, 8RU-M5, 8RU-M6 |

|

39RU-M6 |

39RU-GEN1, 39RU-M5, 39RU-M6 |

|

UGS de grappe principale |

UGS de grappe en attente |

|---|---|

|

8RU-PROD |

8RU-PROD, 8RU-M5 |

|

8RU-M5 |

8RU-PROD, 8RU-M5 |

|

39RU-GEN1 |

39RU-GEN1, 39RU-M5 |

|

39RU-M5 |

39RU-GEN1, 39RU-M5 |

Note |

Communiquez avec le centre d’assistance technique de Cisco pour lancer la restauration des données. |

Vous pouvez déployer une grappe en mode veille en configurant les options de récupération dans les informations de site. Lors de la configuration des informations de site pendant le déploiement, configurez les détails de la restauration sous l’onglet Recovery (Restauration) dans l’interface utilisateur de configuration pendant le déploiement.

Il existe trois modes (voir la section sur les modes de déploiement en veille ) pour déployer une grappe en veille. Pour les trois modes, il faut configurer les paramètres suivants :

Réglez Standby Config(Configuration de veille) sur On (Activée). Vous ne pouvez pas modifier cette configuration une fois qu’elle est définie jusqu’à ce que la grappe soit redéployée.

Configurez le nom et les noms de domaine complets (FQDN) de la grappe principale. Vous pourrez modifier cette configuration ultérieurement.

Note |

Les noms de domaine complets Kafka et du capteur doivent correspondre à ceux de la grappe principale, sinon le processus de restauration échoue. |

Le reste du déploiement est identique au déploiement standard d’une grappe Cisco Secure Workload.

Une bannière s’affiche sur l’interface utilisateur de Cisco Secure Workload lorsque la grappe passe en mode veille.

Le nom et les noms de domaine complet de la grappe principale peuvent être reconfigurés après le déploiement pour permettre à la grappe de secours de suivre une autre grappe. Cela peut être reconfiguré ultérieurement avant que le basculement ne soit déclenché à partir de la page de configuration de la grappe.

Veille à froid : il n’y a pas de grappe de secours. Cependant, la grappe principale sauvegarde les données sur S3. Lors d’un sinistre, une nouvelle grappe (ou la même grappe que la grappe principale) doit être mise en service, déployée en mode de veille et restaurée.

Mode de veille à chaud : une grappe de secours est opérationnelle et déployée en mode veille. Elle récupère périodiquement l’état de la grappe S3 et le positionne à l’état Prêt pour qu’elle soit opérationnelle en cas de sinistre. Pendant un sinistre, connectez-vous à cette nouvelle grappe et déclenchez un basculement.

Veille de secours à chaud (Luke Warm) : plusieurs grappes principales sont assistées par un moins grand nombre de grappes de secours. La grappe de secours est déployée en mode veille. Ce n’est qu’après un sinistre que les informations du compartiment de stockage sont configurées, les données sont prélues et la grappe est restaurée.

|

Step 1 |

(Facultatif) Si vous avez déjà configuré les détails de stockage, passez à l'étape 2. Pour configurer le stockage S3, saisissez les renseignements détaillés suivants :

|

||||

|

Step 2 |

Cliquez sur Test (Tester) pour vérifier si le stockage S3 est accessible à partir de la grappe Cisco Secure Workload. L’état des tests effectués est affiché dans le tableau. En cas d’erreurs de connexion au stockage, lisez la description et corrigez les erreurs pour passer à l’étape suivante. |

||||

|

Step 3 |

Cliquez sur Next (suivant). |

||||

|

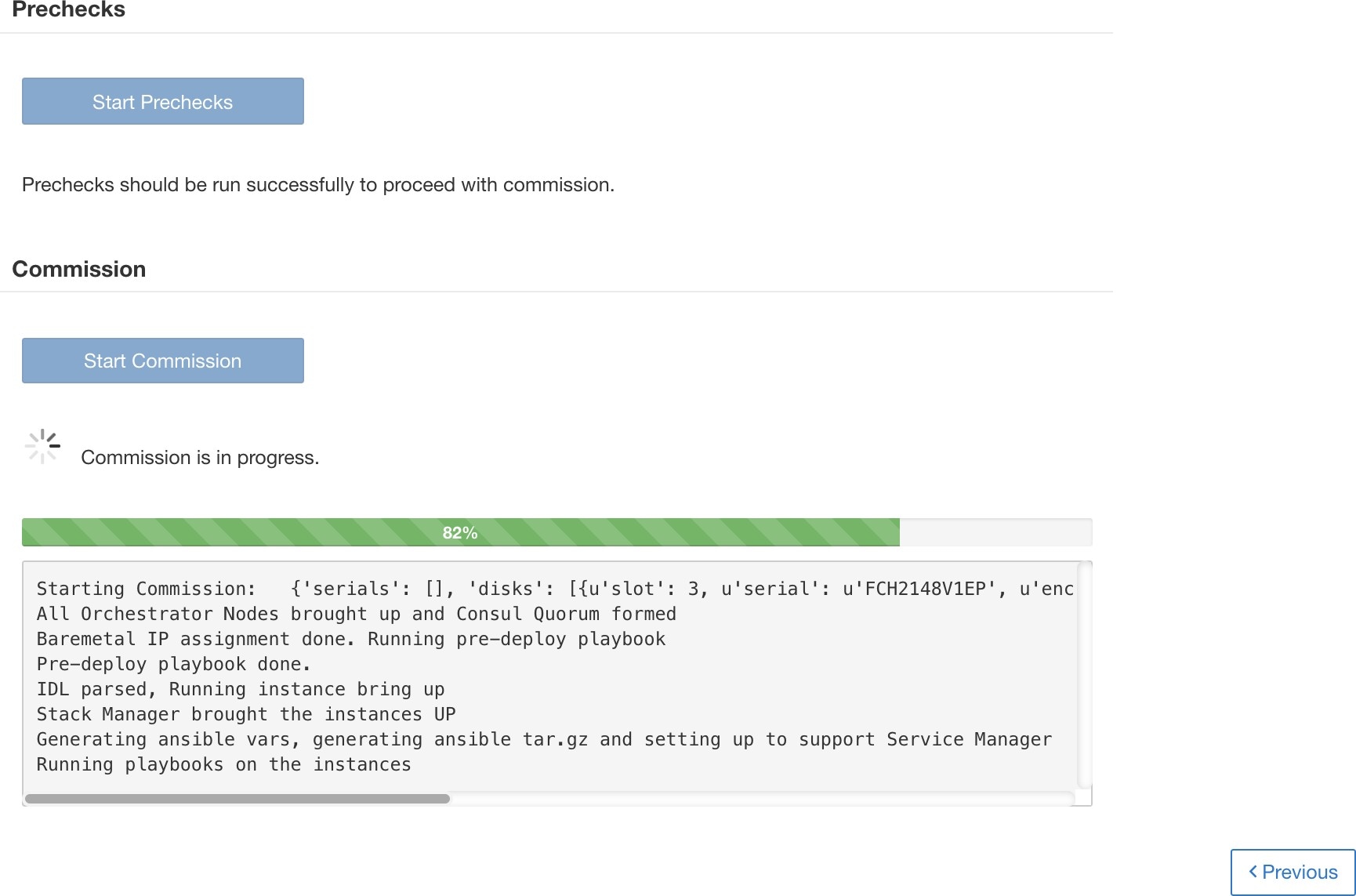

Step 4 |

Sous Prechecks (Vérifications préalables), l’état des vérification préalables effectuées par Cisco Secure Workload est affiché. Pour exécuter manuellement les vérification préalables, cliquez sur Perform Check(exécuter la vérification). L’état de toutes les vérifications est affiché :

|

||||

|

Step 5 |

Cliquez sur Start restore process (Démarrer le processus de restauration). Sous Restore, ((Restaurer) toutes les tâches de restauration de données qui s’exécutent, les détails du stockage S3 configuré et l’état des vérifications préalables de restauration de données s’affichent. |

||||

|

Step 6 |

Cliquez sur Restore now (Restaurer maintenant). |

||||

|

Step 7 |

Dans la boîte de dialogue de confirmation, cochez les cases pour confirmer que vous acceptez le fait que la connectivité de l’agent est perdue et que des données peuvent être perdues pendant la restauration de ces dernières. Cliquez sur Confirm (Confirmer) pour lancer le processus de restauration des données. La progression du processus de restauration des données s’affiche.

Après l’étape du Guide d'activités post-restauration, l’interface graphique est accessible et l’état de toutes les tâches est mis à jour. Un message de confirmation s'affiche pour indiquer que la restauration des données a réussi. |

Mettez à jour votre serveur DNS pour rediriger les noms de domaine complets configurés vers l’adresse IP de la grappe, ce qui garantit que les agents logiciels communiquent avec la grappe une fois le basculement de cette dernière effectué.

Avant de pouvoir restaurer la grappe, elle doit précharger les données. Les données du point de reprise sont prélues à partir du même compartiment de stockage que celui utilisé pour la sauvegarde des données. Des informations d’authentification doivent être fournies pour que le service de sauvegarde puisse être téléchargé à partir du stockage. Si un stockage n’est pas configuré pour la prélecture, l’onglet Data Restore (Restauration des données) lance l’assistant de configuration.

Note |

La grappe de secours interagit uniquement avec le stockage S3. Lorsque la sauvegarde sur la grappe principale est mise à jour pour utiliser un stockage ou un compartiment différent, la grappe de stockage en attente doit être mise à jour. |

Une fois les informations validées, le stockage est automatiquement configuré pour la pré-lecture. L’onglet Restaurer affichera l’état de la pré-lecture.

La page État affiche les éléments suivants :

La section supérieure gauche comporte un graphique indiquant que les divers composants sont prêts à démarrer une restauration. Pour vérifier les données, survolez avec le curseur les composants. Les données associées s’affichent dans la section supérieure droite.

Compartiment : affiche l’état de la pré-lecture. Si les dernières données datent de plus de 45 minutes, elles s’affichent en rouge. Notez que les dernières données datant de plus de 45 minutes n’est pas un problème si la sauvegarde sur le périphérique actif prend plus de 45 minutes pour chaque point de contrôle.

DNS : Affiche les résolutions de nom de domaine complet (FQDN) Kafka et WSS par rapport aux adresses IP des grappes de secours. Pendant la restauration, si les noms de domaine complets ne sont pas mis à jour pour les adresses IP de grappe de secours, l’agent ne peut pas se connecter. Une fois que les noms de domaine complets ont commencé à être résolus vers la grappe de secours, l’état devient vert.

Agents : affiche le nombre d’agents logiciels qui ont basculé avec succès vers la grappe de secours. Cela n’est pertinent qu’après le déclenchement d’une restauration.

La section supérieure droite affiche les renseignements pertinents pour le graphique choisi dans la section de gauche. Cliquez sur Restore Now (Restaurer maintenant) pour lancer le processus de restauration.

La section inférieure gauche affiche les paramètres de stockage de prélecture qui sont utilisés.

La section inférieure droite affiche un graphique des retards de pré-lecture.

Une pré-lecture des données met à jour plusieurs composants nécessaires pour assurer une restauration rapide. Si une pré-lecture de données ne peut pas se terminer, la raison de l’échec est affichée dans la page d’état.

Erreurs courantes qui peuvent entraîner des échecs de pré-lecture :

Erreur d'accès S3 : dans ce cas, les données du stockage n'ont pas pu être téléchargées avec succès. Cela peut se produire en raison de renseignements d’authentification non valides, d’une modification des politiques de stockage ou de problèmes réseau temporaires.

Versions de grappe incompatibles : les données peuvent être restaurées dans une grappe exécutant la même version (y compris la même version de correctif) de Cisco Secure Workload que la grappe principale. Cela peut probablement se produire lors des mises à niveau lorsqu’un seul de la grappe est mis à niveau. Ou, pendant le déploiement, lorsqu’une version différente est utilisée pour le déploiement. Le déploiement des grappes sur une version commune résoudra le problème.

Versions d’UGS incompatibles : notez les UGS autorisées pour les grappes de secours de la grappe principale. Seules des UGS spécifiques sont autorisées pour la restauration de l’UGS de grappe principale.

Les données de la grappe sont restaurées en deux phases :

Phase obligatoire : Les données nécessaires au redémarrage des services sont restaurées en premier. La durée d’une phase obligatoire dépend de la configuration, du nombre d’agents logiciels installés, de la quantité de données sauvegardées et des métadonnées de flux. Pendant la phase obligatoire, l’interface utilisateur n’est pas accessible. Des clés d’invité TA fonctionnels sont nécessaires pour toute prise en charge pendant la phase obligatoire, le cas échéant.

Phase de transmission : les données de la grappe (y compris les données de flux) sont restaurées en arrière-plan et ne bloquent pas l’utilisation de la grappe. L’interface utilisateur de la grappe est accessible et une bannière s’affiche avec le pourcentage de restauration terminée. Pendant cette phase, la grappe est opérationnelle, les pipelines de données fonctionnent normalement et les recherches de flux sont également disponibles.

Une fois la phase obligatoire de la restauration terminée et l’interface utilisateur accessible, les modifications apportées à la grappe doivent être communiquées aux agents logiciels. Dans le serveur DNS utilisé par les agents, l’adresse IP associée au nom de domaine complet de la grappe doit être mise à jour et l’entrée DNS doit pointer vers la grappe restaurée. Une recherche DNS est déclenchée par les agents lorsque la connexion à la grappe principale est interrompue. En fonction de l’entrée DNS mise à jour, les agents se connectent à la grappe restaurée.

Cette section décrit l’objectif de temps de récupération (RTO) et l’objectif de point de récupération (RPO) pour la solution de sauvegarde et de restauration des données.

Une sauvegarde lancée sur la grappe principale nécessite un certain temps pour se terminer en fonction de la quantité de données sauvegardées et de la configuration de la sauvegarde. Les différents modes de sauvegarde définissent l’objectif de point de récupération (RPO) de la solution.

Si elle est planifiée, la sauvegarde non continue est utilisée et est lancée une fois par jour. En cas de sinistre, la durée maximale de perte de données sera d’environ 24 heures, en plus du temps nécessaire pour copier les données dans le stockage de sauvegarde. Par conséquent, l’objectif de point de récupération (RPO) est d’au moins 24 heures.

Si une sauvegarde en mode continu est utilisée, une nouvelle sauvegarde est lancée 15 minutes après la sauvegarde précédente. Chaque sauvegarde prend un certain temps à créer, puis à téléverser les données vers le stockage de sauvegarde. La première sauvegarde est une sauvegarde complète et les sauvegardes suivantes sont des sauvegardes différentielles , les sauvegardes différentielles ne prennent pas beaucoup de temps. En cas de sinistre, la quantité de données perdues correspond à la somme du temps nécessaire pour créer la sauvegarde et du temps nécessaire pour téléverser la sauvegarde dans le système de stockage. Dans ce cas, en général, l’objectif de RPO sera d’environ quelques minutes à une heure.

Lors de la restauration d’une grappe, les données obligatoires sont d’abord extraites du stockage, puis la phase de restauration obligatoire est déclenchée. L’interface utilisateur n’est pas disponible pendant la phase de restauration obligatoire. Une fois la restauration obligatoire terminée, l’interface utilisateur est disponible pour utilisation. Le reste des données est restauré lors de la phase de restauration différée. Dans ce cas, le RTO correspond au temps nécessaire jusqu’à ce que l’interface utilisateur soit disponible pour utilisation une fois la phase obligatoire terminée. Les RTO dépendent du mode de déploiement en veille.

Mode à froid : dans ce mode, la grappe doit d’abord être déployée, ce qui prend environ quelques heures. La grappe doit ensuite être configurée avec les informations d’authentification de stockage de sauvegarde. Comme c’est la première fois que la sauvegarde est téléversée dans la grappe de secours, il y aura beaucoup de données obligatoires qui doivent être récupérées et traitées. La durée de la lecture anticipée est d’environ plusieurs dizaines de minutes (selon la quantité de données sauvegardées). La phase de restauration obligatoire prend environ 30 minutes. L'ensemble forme un temps de RTO d'environ quelques heures, principalement dû au temps nécessaire pour démarrer et déployer la grappe.

Mode de veille à chaud : dans ce mode, la grappe est déjà déployée, mais le stockage de sauvegarde n’est pas configuré. La grappe doit être configurée avec les informations d’authentification de stockage de sauvegarde. Comme c’est la première fois que la sauvegarde est téléversée dans la grappe de secours, il y aura beaucoup de données obligatoires qui doivent être récupérées et traitées. La durée de la lecture anticipée est d’environ plusieurs dizaines de minutes (selon la quantité de données sauvegardées). La phase de restauration obligatoire prend environ 30 minutes. L’ensemble forme un RTO d’environ une à deux heures, selon la quantité de données sauvegardées et le temps nécessaire pour extraire les données du stockage de sauvegarde.

Mode de secours immédiat : dans ce mode, la grappe est déjà déployée, le stockage de sauvegarde est configuré et la prélecture récupère les données du stockage. La grappe peut maintenant être restaurée, ce qui déclenchera la phase de restauration obligatoire, qui prend environ 30 minutes. Cela forme le temps RTO d’environ 30 minutes. Notez qu’il s’écoule un certain délai entre le moment où la sauvegarde est téléversée des processus actifs vers le stockage et le moment où la sauvegarde est extraite par la sauvegarde. Ce délai dure environ quelques minutes. Si la dernière sauvegarde du système actif (avant qu’il ne subisse un sinistre) n’a pas été récupérée préalablement sur la sauvegarde, vous devez attendre quelques minutes pour qu’elle soit récupérée.

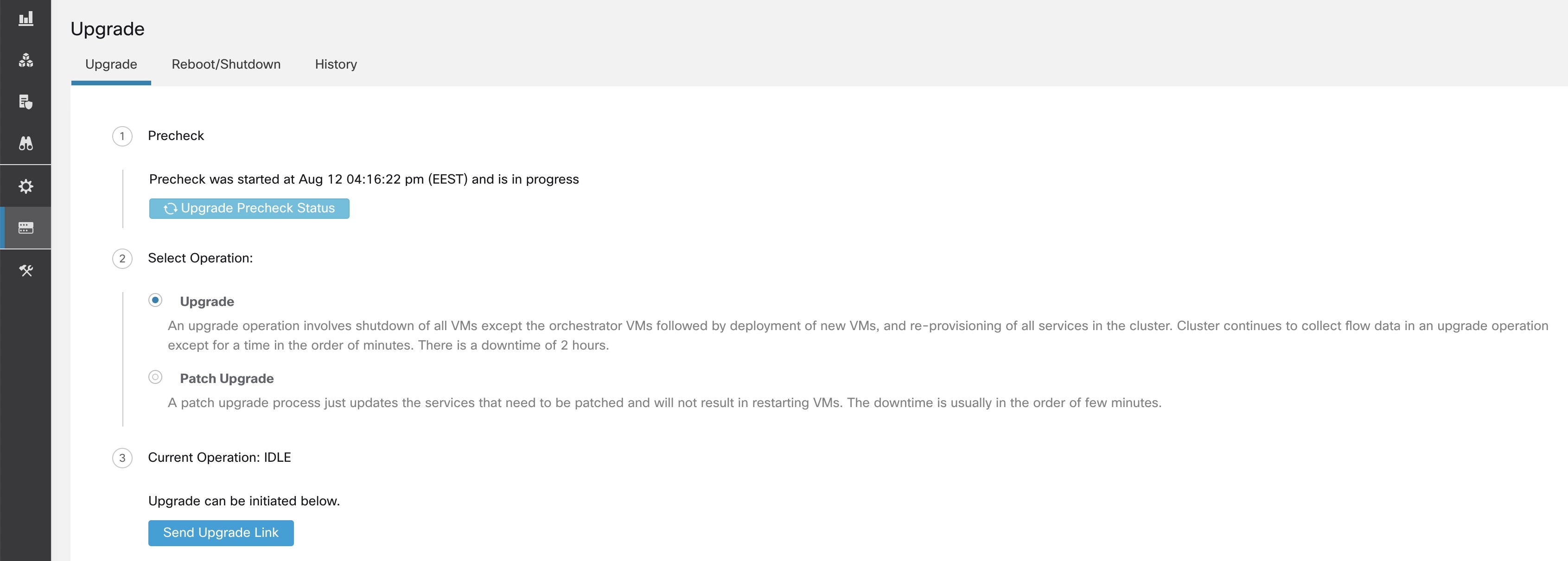

Lorsque la sauvegarde et la restauration des données sont activées sur la grappe, il est recommandé de désactiver la planification avant de commencer la mise à niveau. Reportez-vous à la section Désactivation de la planification de la sauvegarde. Cela garantit qu’il existe une sauvegarde réussie avant de commencer la mise à niveau et qu’aucune nouvelle sauvegarde n’est chargée. Une planification doit être désactivée lorsqu'un point de contrôle n'est pas en cours, afin d'éviter la création d'un point de contrôle défaillant.

Si le test de stockage échoue, identifiez les scénarios de défaillance qui sont affichés dans le volet de droite et vérifiez que :

L’URL de stockage conforme à S3 est correcte.

Les clés d’accès et codes secrets du stockage sont corrects.

Il existe un compartiment de stockage et des autorisations d’accès correctes (lecture/écriture) sont accordées.

Le serveur mandataire est configuré si le stockage doit être accessible directement.

L’option de chargement en plusieurs parties est désactivée si vous utilisez Cohesity.

Le tableau énumère les scénarios d’erreur courants avec résolution et ne constitue pas une liste exhaustive.

| Message d'erreur |

Scénario |

Résolution |

|---|---|---|

|

Introuvable |

Nom de compartiment incorrect | Saisissez le nom correct du compartiment configuré pour le stockage |

|

Erreur de connexion SSL |

Erreur d’expiration ou de vérification du certificat SSL |

Vérifiez le certificat SSL |

|

URL HTTPS non valide |

|

|

|

La connexion a expiré |

L’adresse IP du serveur S3 est inaccessible |

Vérifier la connectivité du réseau entre la grappe et le serveur S3 |

|

Connexion à l'URL impossible |

Région du compartiment incorrecte |

Saisissez la bonne région du compartiment |

|

URL non valide |

Saisissez à nouveau l’URL correcte du point de terminaison de stockage S3 |

|

|

Interdit |

Clé secrète non valide |

Saisissez la clé secrète correcte du stockage |

|

Clé d’accès non valide |

Saisissez la clé d’accès correcte du stockage |

|

|

Impossible de vérifier la configuration S3 |

Autres exceptions ou erreurs génériques |

Essayez de configurer le stockage S3 après un certain temps |

Le tableau répertorie les codes d’erreur courants des points de contrôle et ne constitue pas une liste exhaustive.

|

Code d'erreur |

Description |

|---|---|

|

E101 : Échec du point de contrôle de la base de données |

Impossible de prendre un instantané des journaux des opérations de Mongodb |

|

E102 : Échec du point de contrôle des données de flux |

Impossible de prendre un instantané de la base de données Druid |

|

E103 : Échec du chargement de l’instantané de base de données |

Impossible de télécharger l’instantané de la base de données Mongo |

|

E201 : Échec de copie de base de données |

Impossible de charger l’instantané Mongo dans HDFS |

|

E202 : Échec de copie de configuration |

Impossible de télécharger l’instantané de consultation ou coffre-fort dans HDFS |

|

E203 : Échec du point de contrôle de la configuration |

Impossible de vérifier les données de consultation ou coffre-fort |

|

E204 : Incompatibilité des données de configuration au point de contrôle |

Impossible de générer un point de contrôle de consultation ou de coffre-fort après le nombre maximal de tentatives |

|

E301 : Échec du téléchargement des données de sauvegarde |

Échec du point de contrôle HDFS |

|

E302 : Échec de téléchargement du point de contrôle |

Le pilote de copie n’a pas réussi à charger les données dans S3 |

|

E401 : Mise à niveau du système au point de contrôle |

La grappe a été mise à niveau à ce point de contrôle; le point de contrôle ne peut pas être utilisé |

|

E402 : Redémarrage du service au point de contrôle |

BkpDriver a redémarré à l’état de création; le point de contrôle ne peut pas être utilisé |

|

E403 : Échec au point de contrôle précédent |

Échec du point de contrôle lors de l’exécution précédente |

|

E404 : Un autre point de contrôle en cours |

Un autre point de contrôle est en cours |

|

E405 : Impossible de créer le point de contrôle |

Erreur dans le sous-processus de point de contrôle |

|

Échec : terminé |

Un point de contrôle précédent a échoué; il s'agit probablement d'un chevauchement de plusieurs points de contrôle démarrant en même temps. |

Phase de configuration du stockage : pour obtenir des suggestions de résolution des problèmes lors de la configuration du stockage S3, consultez la section Scénarios d’erreur des vérifications de la configuration S3.

Vérifications préalables pour vérifier l’intégrité de la grappe secondaire : pour les services qui ne sont pas intègres ou ceux qui ont des avertissements, accédez à la page Service Status (État du service) pour obtenir de plus amples renseignements afin d’assurer l'intégrité des services.

Vérifications préalables pour vérifier la connectivité au stockage :

|

Scénario d’erreur |

Description |

|---|---|

|

Impossible de télécharger les données à partir du stockage S3 configuré. |

En raison de la connectivité du réseau, l’accès au stockage S3 a échoué. Le message d'erreur persiste jusqu'à ce qu'un nouveau point de contrôle soit extrait du stockage S3 après le rétablissement de la connectivité. |

|

L’UGS de grappe secondaire (de secours) est incompatible avec la grappe principale. |

Assurez-vous de restaurer les données d’une grappe 39 RU vers une autre grappe 39 RU uniquement. De même, les données de la grappe 8 RU ne peuvent être restaurées que dans une grappe 8 RU. |

|

La version de la grappe secondaire (de secours) est différente de la grappe principale. |

Assurez-vous que les grappes principale et secondaire exécutent la même version. |

|

Échec de la restauration de la base de données MongoDB |

Impossible de restaurer les métadonnées de MongoDB. Le problème sera résolu lors de la prochaine prélecture de point de contrôle. |

|

Le document DBRInfo est dans un format inconnu. |

Les métadonnées du point de contrôle dans le stockage S3 sont endommagées ou le document se trouve dans un stockage incorrect. Téléchargez le fichier dbrinfo.json à partir du stockage S3 et partagez-le avec le centre d'assistance technique Cisco TAC pour vérification. |

|

Synchronisation impossible avec le service de copie. |

Erreurs internes entre le gestionnaire de restauration des données et le service de copie S3. Communiquez avec le centre d’assistance technique (Cisco TAC) pour résoudre le problème. |

Vérifications préalables du nom de domaine complet (FQDN) : si un panneau d’avertissement s’affiche à côté des vérification préalables du nom de domaine complet (FQDN), cela signifie que l’entrée DNS pour les noms de domaine complets ne pointe pas vers la grappe secondaire.

Résolution : après la restauration des données, modifiez l’entrée DNS pour activer la connectivité entre les agents logiciels et la grappe secondaire.

Phase de restauration des données : dans la boîte de dialogue de confirmation de la restauration des données, si la case de l’orchestrateur externe n’est pas une coche verte, vérifiez la connectivité entre la grappe secondaire et les orchestrateurs externes.

Note |

Une fois les données restaurées et que la grappe secondaire a atteint l’état principal, la page de restauration des données est toujours accessible pour vérifier le temps qui a été nécessaire et le nombre d’agents qui se sont reconnectés. Pour une grappe où les données ne sont jamais restaurées, la page de restauration des données est vide. |

Cisco Secure Workload offre une haute disponibilité en cas de probabilité de défaillance des services, des nœuds et des machines virtuelles. La haute disponibilité fournit des méthodes de récupération en assurant un temps d’arrêt minimal et une intervention minimale de l’administrateur du site.

Dans Cisco Secure Workload, les services sont répartis sur les nœuds d’une grappe. Plusieurs instances de services sont exécutées simultanément sur les nœuds. Une instance principale et une ou plusieurs instances secondaires sont configurées pour une haute disponibilité sur plusieurs nœuds. Lorsque l’instance principale d’un service tombe en panne, une instance secondaire du service est considérée comme principale et devient active immédiatement.

Les composants clés d’une grappe Cisco Secure Workload sont les suivants :

Des serveurs sans système d’exploitation qui hébergent plusieurs machines virtuelles, qui hébergent à leur tour de nombreux services.

Serveurs sur bâti Cisco UCS de série C avec les commutateurs de la gamme Cisco Nexus 9300 qui contribuent à un réseau intégré haute performance.

Modèles d’appareils matériels en petit ou grand format pour prendre en charge un nombre précis de charges de travail :

Déploiement de petit format avec six serveurs et deux commutateurs Cisco Nexus 9300.

Déploiement de grand format avec 36 serveurs et trois commutateurs Cisco Nexus 9300.

|

Attributs/Format |

8 RU |

39 RU |

|---|---|---|

|

Nombre de nœuds |

6 |

36 |

|

Nombre de nœuds de traitement informatiques |

— |

16 |

|

Nombre de nœuds de base |

— |

12 |

|

Nombre de nœuds de service |

— |

8 |

|

Nombre de nœuds universels |

6 |

— |

|

Nombre de machines virtuelles |

50 |

106 |

|

Nombre de collecteurs |

6 |

16 |

|

Nombre de commutateurs de réseau |

2 |

3 |

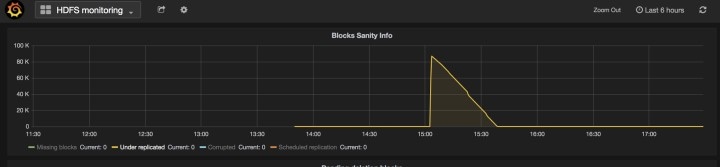

Dans les deux formats (8RU et 39RU) de grappe, si un nœud défaillant héberge une machine virtuelle NameNode Hadoop, une intervention manuelle est nécessaire pour basculer vers une machine virtuelle NameNode secondaire.

Note |

Le basculement n’est pas automatique dans les versions 3.8.x et antérieures de Cisco Secure Workload. |

À partir de la version 3.9.x de Cisco Secure Workload, dans les facteurs de forme de grappe 8RU et 39RU, si un nœud qui héberge une VM Hadoop NameNode est défaillant, il n’est pas nécessaire d’intervenir manuellement pour basculer vers une VM secondaire.

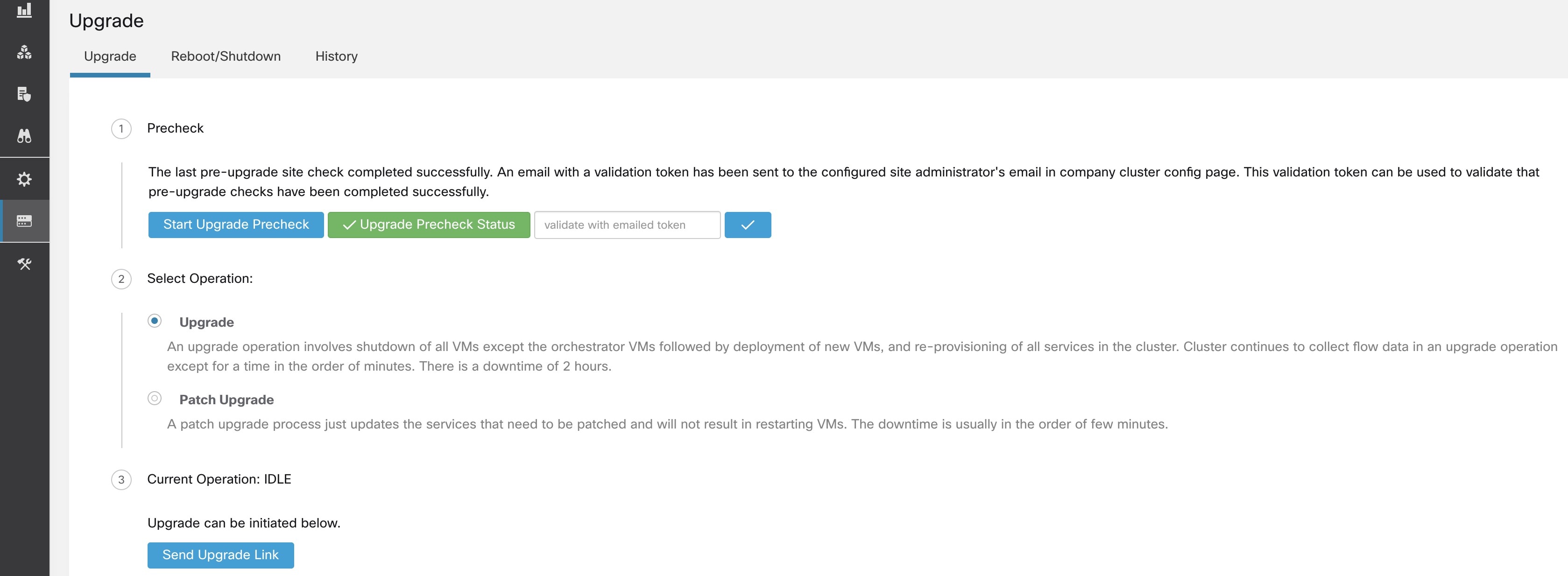

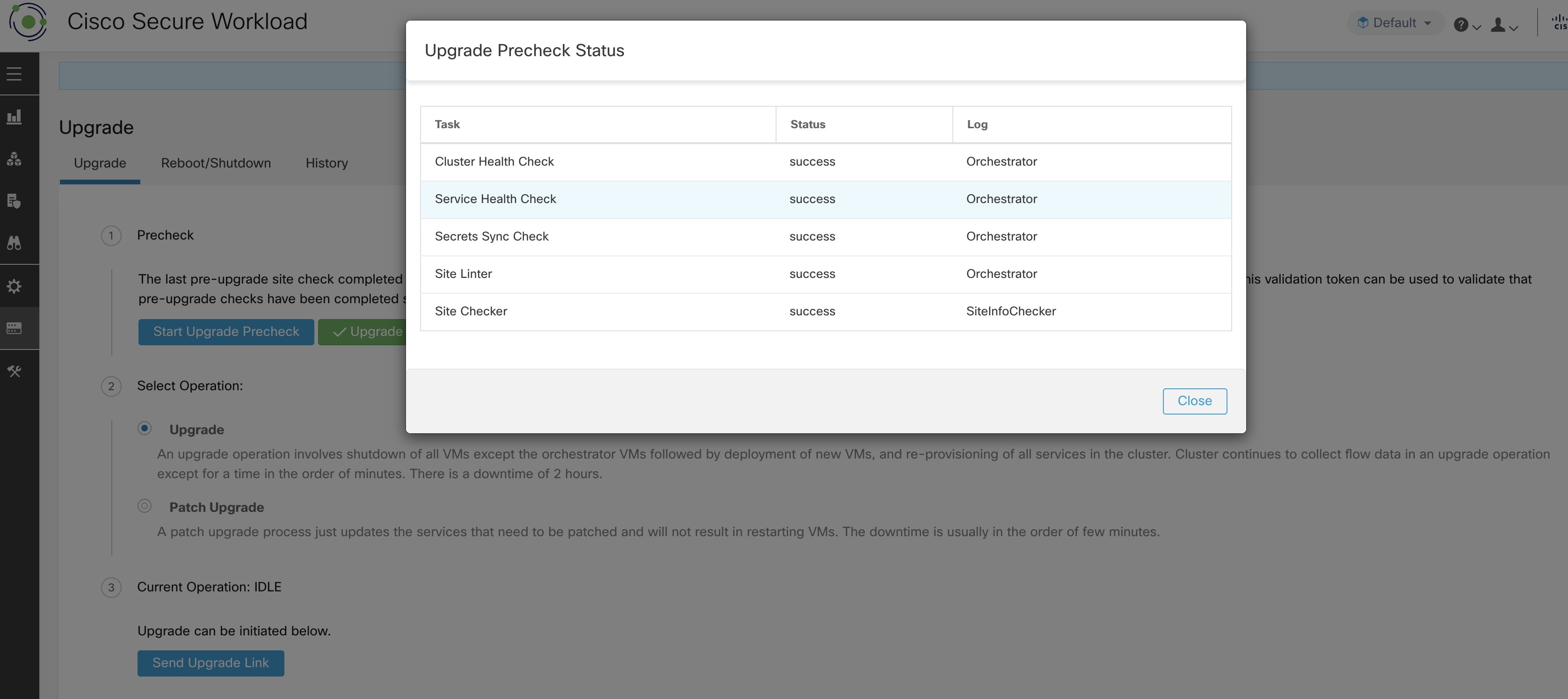

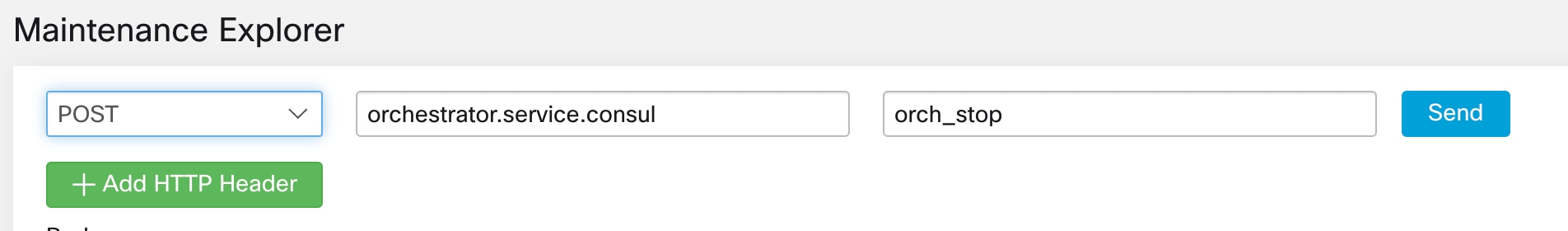

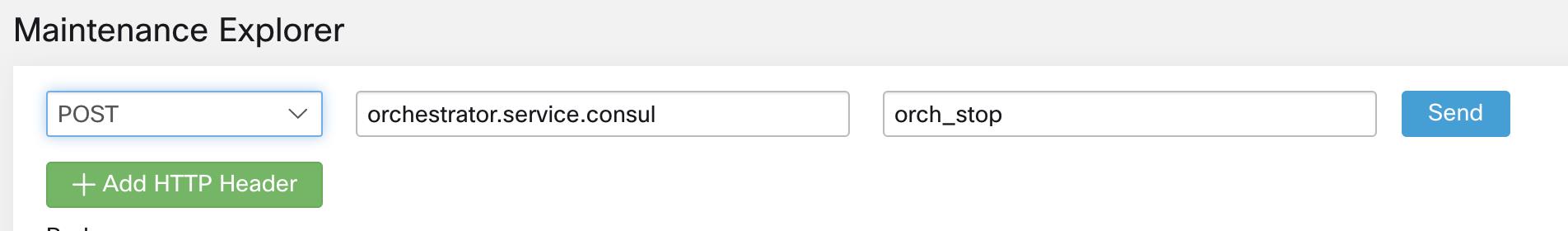

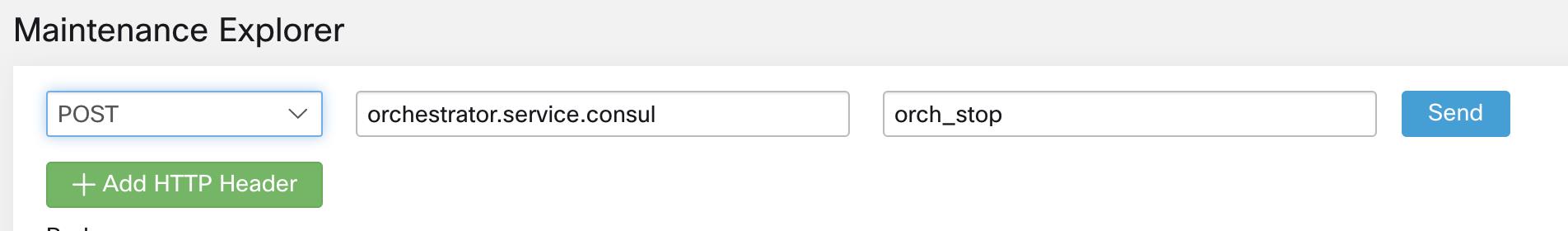

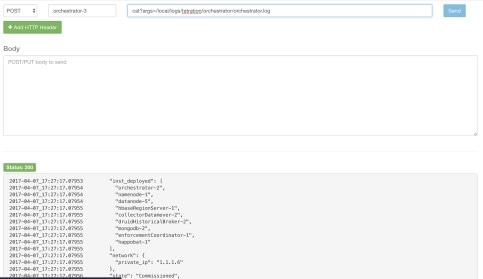

Avant d’effectuer une MISE À NIVEAU ou un REDÉMARRAGE, une intervention manuelle est nécessaire si la vérification préalable

à la mise à niveau indique que Namenode-1 n’est pas actif ou dans un état normal. Si tel est le cas, vous devez effectuer

un POST namenode_failover sur launcherHost-1.node.consul (ou sur tout autre launcherHosts en cours d’exécution) à partir de la page Explore.

Note |

Le basculement n’est pas automatique dans les versions 3.8.x et antérieures de Cisco Secure Workload. |

Pour un service à 2 ou 3 VM, comme les orchestrateurs, Redis, MongoDB, Elasticsearch, enforcementpolicystore, AppServer, ZooKeeper, TSDB, Grafana etc., une seule défaillance de machine virtuelle est prise en charge; une deuxième défaillance de la machine virtuelle rend le service inactif.

Cela n'a aucune incidence sur le fonctionnement de la grappe à un moment donné.

Il n’y a pas de point de défaillance unique. La défaillance de l’un des nœuds ou des machines virtuelles d’une grappe n’entraîne pas la défaillance de la grappe entière.

Les temps d’arrêt liés à la reprise après défaillance en raison des services, des nœuds ou des machines virtuelles sont minimes.

Cela n’a aucune incidence sur les connexions maintenues par les agents logiciels à une grappe Cisco Secure Workload. Les agents communiquent avec tous les collecteurs disponibles dans la grappe. En cas de défaillance d'un collecteur ou d'une machine virtuelle, les connexions des agents logiciels aux autres instances de collecteurs garantissent que le flux de données n'est pas interrompu et qu'il n'y a pas de perte de fonctionnalité.